目录

1. 引言

在深度学习领域中,长短期记忆网络(Long Short-Term Memory,LSTM)是一种重要的模型,特别适用于处理序列数据。本文将深入探讨LSTM的原理、结构、训练方法、应用场景等方面,以更加详细的方式理解这一神经网络模型。

2. LSTM的原理

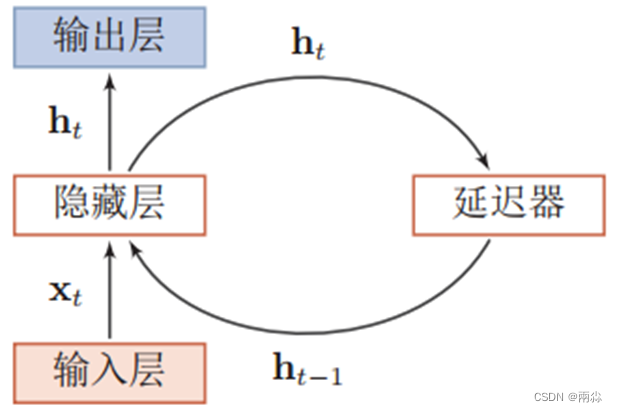

2.1 循环神经网络(RNN)的问题

传统的循环神经网络在处理长序列数据时,容易遇到梯度消失和梯度爆炸的问题。这主要是由于反向传播过程中,随着时间步的增加,梯度会不断相乘或相加,导致梯度逐渐消失或爆炸。

2.2 LSTM的解决方案

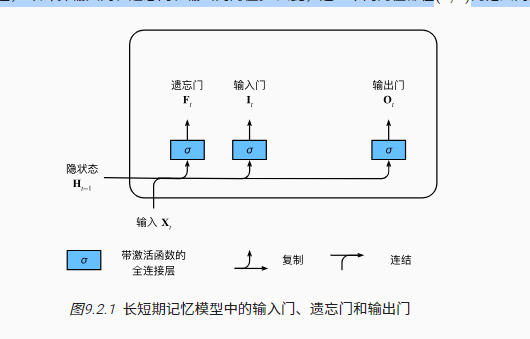

LSTM引入了一种称为“记忆单元”(memory cell)的结构,以解决长期依赖问题。记忆单元通过门控机制来控制信息的流动,并且可以在不同的时间步长上保持和传递信息,避免了梯度消失和爆炸的问题。主要的门包括遗忘门、输入门和输出门。

2.3 主要组件

- 细胞状态(Cell State):细胞状态贯穿于整个LSTM网络中,可以在不同时间步长上保持和传递信息,是LSTM的核心组件之一。

- 遗忘门(Forget Gate):决定是否丢弃细胞状态中的某些信息,帮助模型记住或忽略之前的信息。

- 输入门(Input Gate):负责决定更新细胞状态的哪些部分,控制新的信息如何被添加到细胞状态中。

- 输出门(Output Gate):决定细胞状态中的哪些部分会输出到当前时刻的隐藏状态,从而影响网络的输出。

3. LSTM的结构

LSTM网络由多个LSTM单元组成,每个LSTM单元包括一个记忆单元和三个门。记忆单元存储了长期的信息,而门控制了信息的流动。具体而言:

- 遗忘门:决定从记忆单元中丢弃哪些信息。它通过当前输入和前一个时刻的隐藏状态来计算。

- 输入门:决定更新记忆单元的哪些部分。它通过当前输入和前一个时刻的隐藏状态来计算。

- 细胞状态:细胞状态贯穿整个LSTM单元,负责存储长期的信息。

- 输出门:决定从细胞状态中输出哪些信息到当前时刻的隐藏状态。

这种结构使得LSTM能够更好地捕捉序列数据中的长期依赖关系。

4. LSTM的训练方法

4.1 损失函数

LSTM的训练通常通过最小化损失函数来完成。损失函数可以根据具体任务的不同而变化,例如在分类任务中常使用交叉熵损失函数,在回归任务中常使用均方误差损失函数等。

4.2 参数优化

LSTM的参数优化通常采用梯度下降算法及其变种。在梯度下降的过程中,通过计算损失函数关于参数的梯度,并根据梯度的方向更新参数,从而逐步优化模型的性能。

4.3 初始化

在训练过程中,需要对LSTM的参数进行初始化。通常采用随机初始化的方法,以确保模型具有足够的灵活性和泛化能力。

5. LSTM的应用场景

5.1 自然语言处理(NLP)

LSTM在NLP领域有着广泛的应用,包括文本分类、情感分析、机器翻译等任务。其强大的序列建模能力使得它能够处理各种类型的自然语言数据,并取得良好的效果。

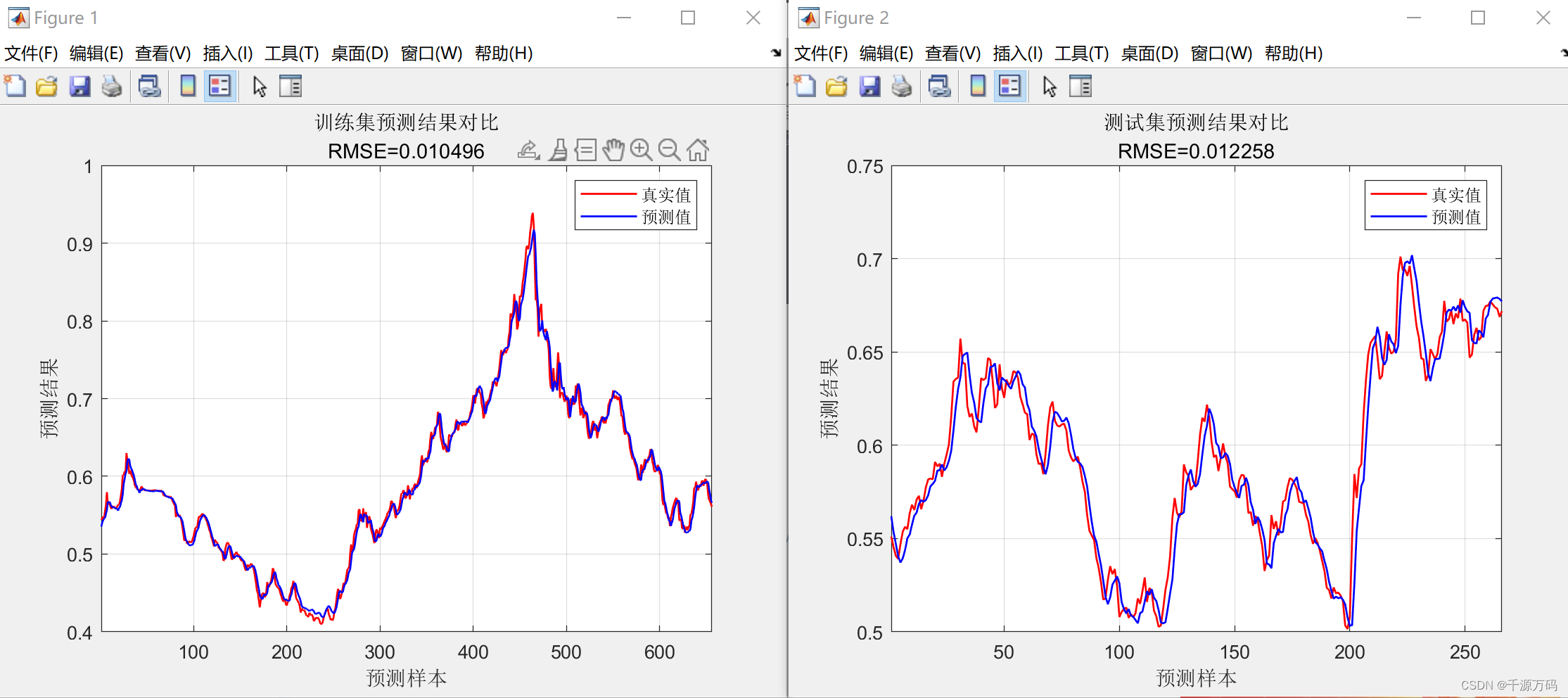

5.2 时间序列预测

由于LSTM能够捕捉序列数据中的长期依赖关系,因此在时间序列预测领域也有着广泛的应用。例如,股票价格预测、天气预测等任务都可以通过LSTM来实现。

5.3 语音识别

LSTM在语音识别系统中也有着重要的应用。通过LSTM可以对语音信号进行序列建模,从而实现对语音的识别和理解。

6.用python实现LSTM示例

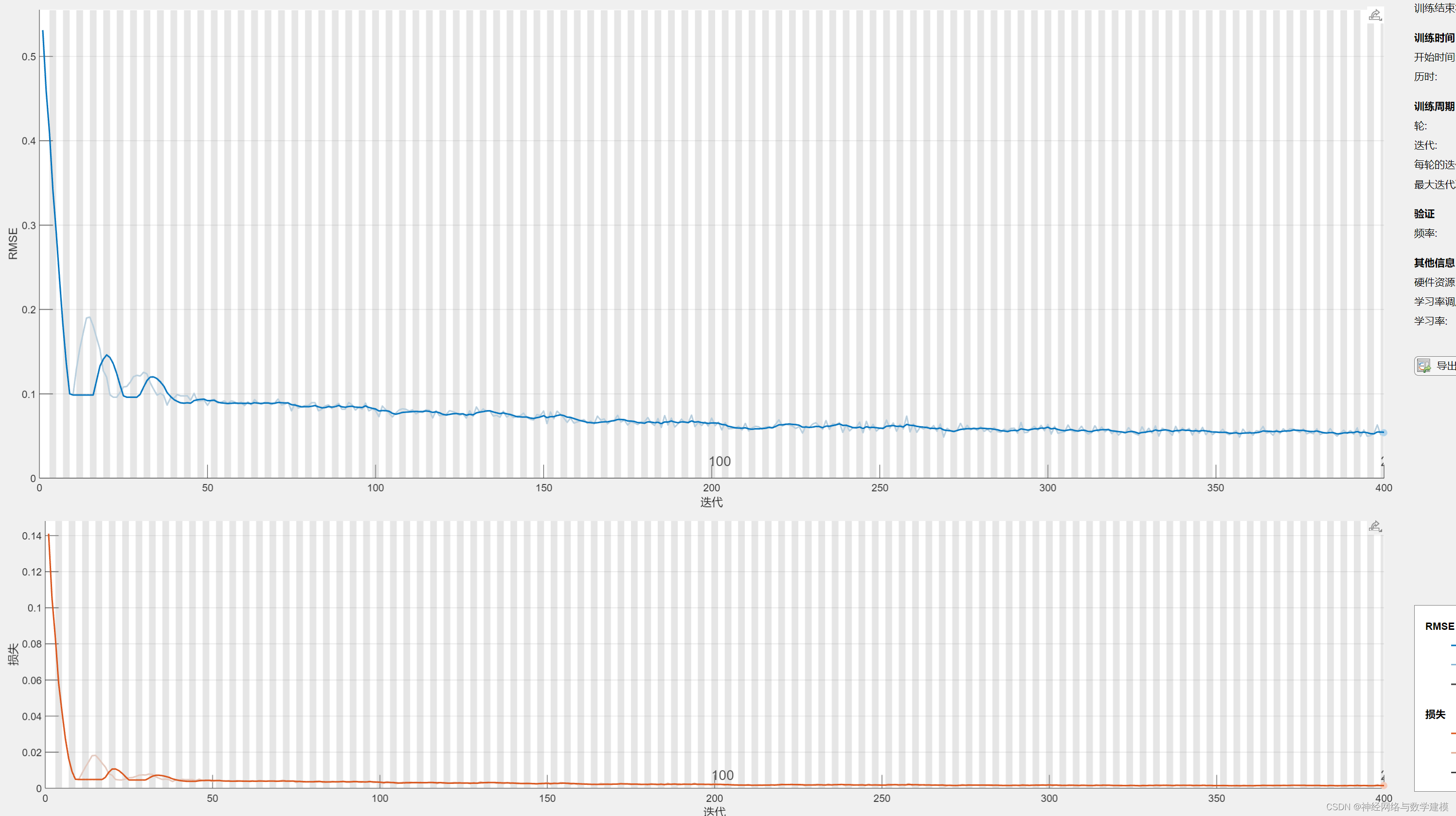

6.1TensorFlow框架

下面示例代码实现了一个简单的LSTM模型来对MNIST手写数字进行分类。该模型具有一个LSTM层和一个全连接层,输入数据是28x28的图像,经过一系列的LSTM单元,然后经过一个全连接层输出分类结果。

import tensorflow as tf

# 定义超参数

epochs = 10

batch_size = 64

input_dim = 28

timesteps = 28

hidden_dim = 128

output_dim = 10

# 加载MNIST数据集

mnist = tf.keras.datasets.mnist

(x_train, y_train), (x_test, y_test) = mnist.load_data()

x_train, x_test = x_train / 255.0, x_test / 255.0

# 创建LSTM模型

model = tf.keras.models.Sequential([

tf.keras.layers.LSTM(hidden_dim, input_shape=(timesteps, input_dim)),

tf.keras.layers.Dense(output_dim, activation='softmax')

])

# 编译模型

model.compile(optimizer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

# 打印模型结构

model.summary()

# 训练模型

model.fit(x_train, y_train,

epochs=epochs,

batch_size=batch_size,

validation_data=(x_test, y_test))

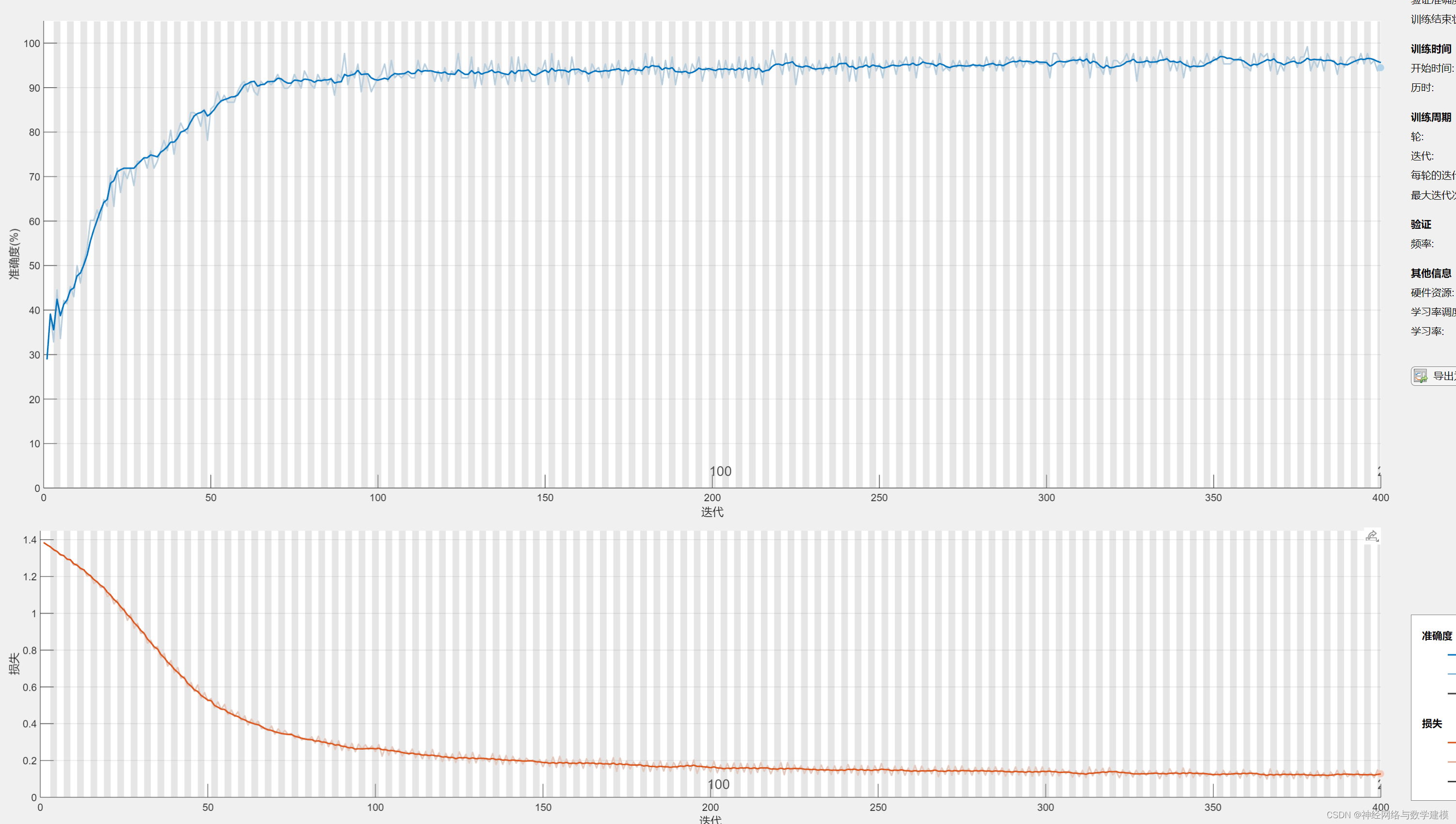

6.2Pytorch框架

import torch

import torch.nn as nn

import torchvision.datasets as datasets

import torchvision.transforms as transforms

from torch.utils.data import DataLoader

# 定义超参数

sequence_length = 28

input_size = 28

hidden_size = 128

num_layers = 2

num_classes = 10

batch_size = 64

num_epochs = 10

learning_rate = 0.001

# 加载MNIST数据集

train_dataset = datasets.MNIST(root='./data', train=True, transform=transforms.ToTensor(), download=True)

test_dataset = datasets.MNIST(root='./data', train=False, transform=transforms.ToTensor())

# 数据加载器

train_loader = DataLoader(dataset=train_dataset, batch_size=batch_size, shuffle=True)

test_loader = DataLoader(dataset=test_dataset, batch_size=batch_size, shuffle=False)

# 定义LSTM模型

class LSTMModel(nn.Module):

def __init__(self, input_size, hidden_size, num_layers, num_classes):

super(LSTMModel, self).__init__()

self.hidden_size = hidden_size

self.num_layers = num_layers

self.lstm = nn.LSTM(input_size, hidden_size, num_layers, batch_first=True)

self.fc = nn.Linear(hidden_size, num_classes)

def forward(self, x):

h0 = torch.zeros(self.num_layers, x.size(0), self.hidden_size).to(device)

c0 = torch.zeros(self.num_layers, x.size(0), self.hidden_size).to(device)

out, _ = self.lstm(x, (h0, c0))

out = self.fc(out[:, -1, :])

return out

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

model = LSTMModel(input_size, hidden_size, num_layers, num_classes).to(device)

# 定义损失函数和优化器

criterion = nn.CrossEntropyLoss()

optimizer = torch.optim.Adam(model.parameters(), lr=learning_rate)

# 训练模型

total_step = len(train_loader)

for epoch in range(num_epochs):

for i, (images, labels) in enumerate(train_loader):

images = images.reshape(-1, sequence_length, input_size).to(device)

labels = labels.to(device)

# 前向传播

outputs = model(images)

loss = criterion(outputs, labels)

# 反向传播和优化

optimizer.zero_grad()

loss.backward()

optimizer.step()

if (i+1) % 100 == 0:

print ('Epoch [{}/{}], Step [{}/{}], Loss: {:.4f}'

.format(epoch+1, num_epochs, i+1, total_step, loss.item()))

# 模型评估

with torch.no_grad():

correct = 0

total = 0

for images, labels in test_loader:

images = images.reshape(-1, sequence_length, input_size).to(device)

labels = labels.to(device)

outputs = model(images)

_, predicted = torch.max(outputs.data, 1)

total += labels.size(0)

correct += (predicted == labels).sum().item()

print('测试集准确率: {} %'.format(100 * correct / total))

7. 结论

长短期记忆网络(LSTM)作为一种强大的序列建模工具,在处理各种序列数据任务中展现出了良好的性能。通过引入记忆单元和门控机制,LSTM能够有效地解决传统循环神经网络中的长期依赖问题,并在自然语言处理、时间序列预测、语音识别等领域取得了广泛的应用。随着深度学习技术的不断发展,LSTM以其独特的优势将继续在序列数据处理领域发挥重要作用。

![[图像处理] MFC OnMouseMove()绘制ROI矩形时的闪烁问题](https://img-blog.csdnimg.cn/direct/e891e60017ff457686ba34d0f854e397.gif#pic_center)

![[Linux]一篇文章带你搞定软硬连接](https://img-blog.csdnimg.cn/direct/75bc82aa05d246f4857a2ef37eb19f8b.png#pic_center)