理解自然语言处理中的信息熵

本文将从以下六个方面进行阐述:

- 背景介绍

- 核心概念与联系

- 核心算法原理和具体操作步骤以及数学模型公式详细讲解

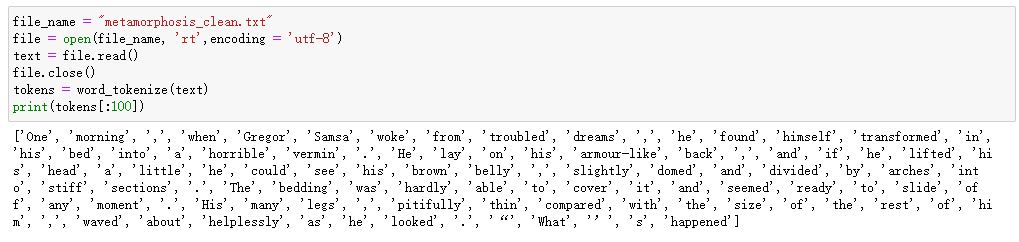

- 具体代码实例和详细解释说明

- 附录常见问题与解答

1. 背景介绍

在自然语言处理(NLP)的领域,熵是一个至关重要的概念。它不仅帮助我们量化信息的不确定性或随机性,而且深入影响着语言编码、存储、传输和处理的效率。通过分析语言的熵,我们能够更好地理解自然语言的复杂性,并探索提高处理效率的方法。

2. 核心概念与联系

2.1 熵的定义

熵(Entropy)是信息论的一个基本概念,用于度量一个系统的不确定性。在信息论中,熵被定义为:

H ( X ) = − ∑ i = 1 n P ( x i ) log P ( x i ) H(X) = -\sum_{i=1}^{n} P(x_i) \log P(x_i) H(X)=−i=1∑nP(xi)logP(xi)

其中, X X X 是一个随机变量,取值为 x 1 , x 2 , … , x n x_1, x_2, \dots, x_n x1,x2,…,xn, P ( x i ) P(x_i) P(xi) 是 x i x_i xi 的概率。熵的单位是比特(bit),用于度量信息的纯度。

2.2 熵与自然语言处理的联系

在自然语言处理中,熵可以用来度量文本信息的不确定性。具体来说,熵可以用于计算单词的熵,以及文本的熵。单词的熵可以用来度量单词的不确定性,而文本的熵可以用来度量文本的多样性和复杂性。

此外,熵还可以用于计算条件熵,即给定某个条件下的不确定性。这在自然语言处理中非常重要,因为我们需要根据上下文来理解和生成语言。

3. 核心算法原理和具体操作步骤以及数学模型公式详细讲解

3.1 计算单词熵

3.1.1 理论

要计算单词的熵,我们需要知道单词在文本中的出现概率。假设我们有一个文本,其中包含 N N N 个单词,我们可以计算单词 w w w 的熵如下:

- 统计单词 w w w 在文本中出现的次数 C w C_w Cw。

- 计算单词 w w w 的概率 P ( w ) P(w) P(w):

P ( w ) = C w N P(w) = \frac{C_w}{N} P(w)=NCw - 使用熵公式计算单词 w w w 的熵:

H ( w ) = − ∑ i = 1 n P ( x i ) log P ( x i ) H(w) = -\sum_{i=1}^{n} P(x_i) \log P(x_i) H(w)=−i=1∑nP(xi)logP(xi)

其中, x i x_i xi 是单词 w w w 的每个可能的取值。

3.1.2 例子

设想我们有一段文本,文本内容如下:

hello world hello hello world

这段文本由5个单词组成,其中"hello"出现了3次,"world"出现了2次。现在,我们计算单词"hello"和"world"的熵。

步骤1: 统计单词出现的次数

- C hello = 3 C_{\text{hello}} = 3 Chello=3

- C world = 2 C_{\text{world}} = 2 Cworld=2

步骤2: 计算单词的概率

- 总单词数 N = 5 N = 5 N=5

- P ( hello ) = C hello N = 3 5 P(\text{hello}) = \frac{C_{\text{hello}}}{N} = \frac{3}{5} P(hello)=NChello=53

- P ( world ) = C world N = 2 5 P(\text{world}) = \frac{C_{\text{world}}}{N} = \frac{2}{5} P(world)=NCworld=52

步骤3: 使用熵公式计算单词的熵

由于我们只关注单个单词的熵,在这个例子中,每个单词只有一种取值,即其自身。因此,熵的计算将简化为每个单词的概率乘以其概率的对数。

对于"hello":

H ( hello ) = − P ( hello ) log 2 P ( hello ) = − 3 5 log 2 3 5 H(\text{hello}) = -P(\text{hello}) \log_2 P(\text{hello}) = -\frac{3}{5} \log_2 \frac{3}{5} H(hello)=−P(hello)log2P(hello)=−