【mT5中的激活函数】GLU Variants Improve Transformer

论文信息

| 名称 | 内容 |

|---|---|

| 论文标题 | GLU Variants Improve Transformer |

| 论文地址 | https://arxiv.org/abs/2002.05202 |

| 发表时间 | 2020-02-12 |

| 研究领域 | NLP, 激活函数, FNN |

| 提出方法 | GEGLU(激活函数) |

阅读评价

论文在各种激活函数之间做了对比实验,探究应用不同激活函数的FNN对T5模型的影响。最终GEGLU效果最好。

个人感受:只能说太细了!真是不给其他人一点活路,连激活函数他都要做个实验取个最好的。

以下是对论文每个部分的简单介绍。

Abstract

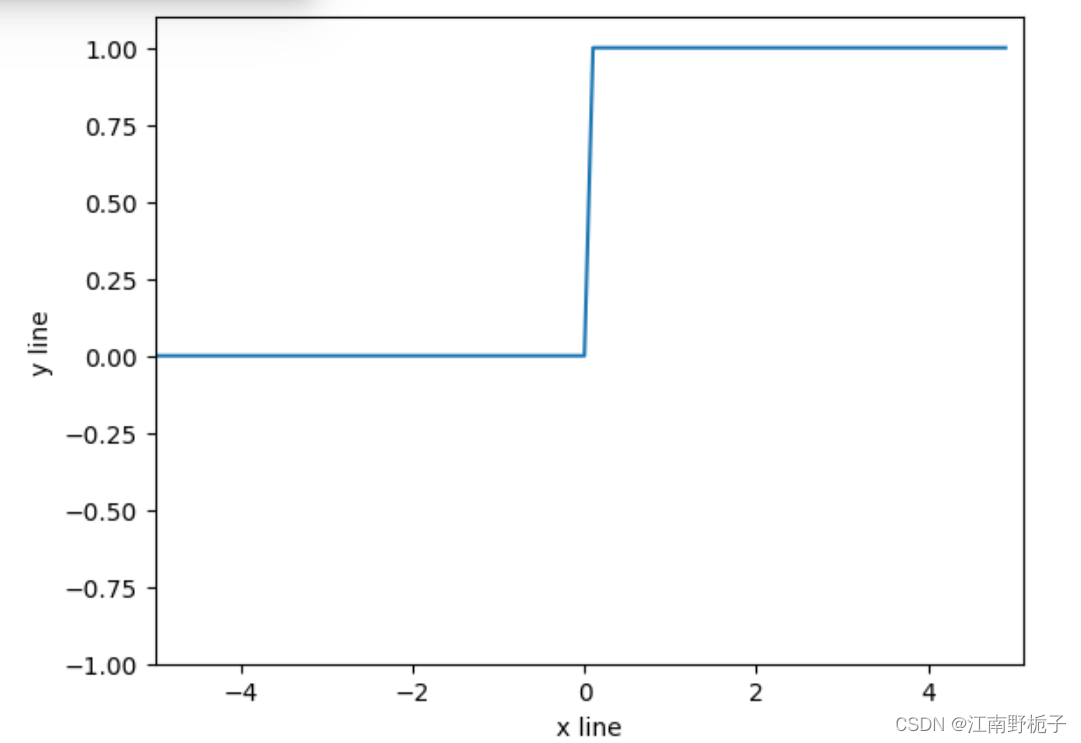

门控线性单元(Gated Linear Units, GLU)由两个线性投影的分量乘积组成,其中一个投影首先通过sigmoid函数。对于GLU中的激活函数,也是调参中的一个点。论文在FFN中应用了GLU的一些变体,发现其中一些变体的质量优于通常使用的ReLU或GELU激活。

Introduction

介绍了四种基于不同激活函数的FFN。

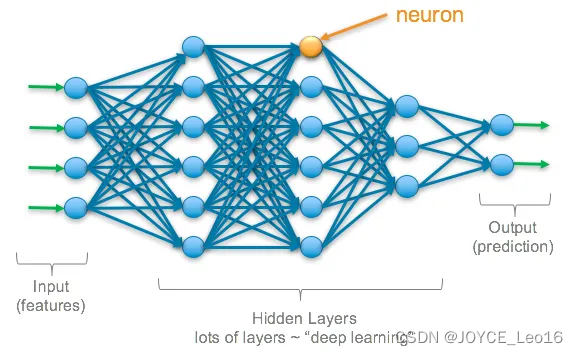

Transformer 论文中提出的前馈网络(Feed-Forward Network, FNN)是一个两层的全连接神经网络,它在 Transformer 模型中起到了重要的作用。这个网络的结构是:

F F N ( x , W 1 , W 2 , b 1 , b 2 ) = m a x ( 0 , x W 1 + b 1 ) W 2 + b 2 FFN(x, W_1, W_2, b_1, b_2) = max(0, xW_1 + b_1)W_2 + b_2 FFN(x,W1,W2,b1,b2)=max(0,xW1+b1)W2+b2

其中, x x x 是输入, W 1 W_1 W1 和 W 2 W_2 W2 是权重矩阵, b 1 b_1 b1 和 b 2 b_2 b2 是偏置向量。这个公式首先通过一个线性变换 x W 1 + b 1 xW_1 + b_1 xW1+b1,然后通过ReLU激活函数,最后再通过另一个线性变换 W 2 W_2 W2 和偏置 b 2 b_2 b2。

在 T5 论文中,作者对前馈网络进行了一些调整,取消了偏置项。这样做的目的是为了简化模型和提高训练效率。调整后的前馈网络结构是:

F F N R e L U ( x , W 1 , W 2 ) = m a x ( 0 , x W 1 ) W 2 FFN_{ReLU}(x, W_1, W_2) = max(0, xW_1)W_2 FFNReLU(x,W1,W2)=max(0,xW1)W2

这个公式中,去掉了偏置项 b 1 b_1 b1 和 b 2 b_2 b2,只保留了ReLU激活函数和两个权重矩阵。

除了ReLU激活函数,还有一些其他的激活函数被用于前馈网络中。例如,基于高斯误差函数的激活函数GELU可以用于前馈网络,其结构是:

F F N G E L U ( x , W 1 , W 2 ) = G E L U ( x W 1 ) W 2 FFN_{GELU}(x, W_1, W_2) = GELU(xW_1)W_2 FFNGELU(x,W1,W2)=GELU(xW1)W2

GELU激活函数可以更好地模拟神经网络的随机正则化行为,从而提高模型的性能。

另一个被用于前馈网络的激活函数是Swish。Swish激活函数是一个自门控的激活函数,它可以自动调节每个神经元的输出。基于Swish激活函数的前馈网络结构是:

F F N S w i s h ( x , W 1 , W 2 ) = S w i s h ( x W 1 ) W 2 FFN_{Swish}(x, W_1, W_2) = Swish(xW_1)W_2 FFNSwish(x,W1,W2)=Swish(xW1)W2

Swish激活函数在某些情况下可以提高神经网络的性能,因此在设计前馈网络时,可以根据具体的应用场景选择合适的激活函数。

【注】为什么FNN里面要有激活函数?

————————————

答:1)提供非线性拟合能力,没有激活函数的模型只是线性层的累加。2)部分激活函数如ReLU能够缓解梯度消失问题,加快模型速度。

Gated Linear Units (GLU) and Variants

GLU的公式为:

G L U ( x , W , V , b , c ) = σ ( x W + b ) ⊗ ( x V + c ) GLU(x, W, V, b, c) = σ(xW + b) ⊗ (xV + c) GLU(x,W,V,b,c)=σ(xW+b)⊗(xV+c)

在GLU的基础上,取消激活函数,称之为Bilinear。Bilinear公式为:

B i l i n e a r ( x , W , V , b , c ) = ( x W + b ) ⊗ ( x V + c ) Bilinear(x, W, V, b, c) = (xW + b) ⊗ (xV + c) Bilinear(x,W,V,b,c)=(xW+b)⊗(xV+c)

因此在GLU的基础上,作者认为可以产生以下变体:

R e G L U ( x , W , V , b , c ) = m a x ( 0 , x W + b ) ⊗ ( x V + c ) G E G L U ( x , W , V , b , c ) = G E L U ( x W + b ) ⊗ ( x V + c ) S w i G L U ( x , W , V , b , c , β ) = S w i s h β ( x W + b ) ⊗ ( x V + c ) ReGLU(x, W, V, b, c) = max(0, xW + b) ⊗ (xV + c) \\ GEGLU(x, W, V, b, c) = GELU(xW + b) ⊗ (xV + c) \\ SwiGLU(x, W, V, b, c, β) = Swishβ(xW + b) ⊗ (xV + c) ReGLU(x,W,V,b,c)=max(0,xW+b)⊗(xV+c)GEGLU(x,W,V,b,c)=GELU(xW+b)⊗(xV+c)SwiGLU(x,W,V,b,c,β)=Swishβ(xW+b)⊗(xV+c)

基于上述的激活函数,产生以下FNN变体:

F F N G L U ( x , W , V , W 2 ) = ( σ ( x W ) ⊗ x V ) W 2 F F N B i l i n e a r ( x , W , V , W 2 ) = ( x W ⊗ x V ) W 2 F F N R e G L U ( x , W , V , W 2 ) = ( m a x ( 0 , x W ) ⊗ x V ) W 2 F F N G E G L U ( x , W , V , W 2 ) = ( G E L U ( x W ) ⊗ x V ) W 2 F F N S w i G L U ( x , W , V , W 2 ) = ( S w i s h 1 ( x W ) ⊗ x V ) W 2 FFN_{GLU}(x, W, V, W_2) = (σ(xW ) ⊗ xV )W_2\\ FFN_{Bilinear}(x, W, V, W_2) = (xW ⊗ xV )W_2\\ FFN_{ReGLU}(x, W, V, W_2) = (max(0, xW ) ⊗ xV )W_2\\ FFN_{GEGLU}(x, W, V, W_2) = (GELU(xW ) ⊗ xV )W_2\\ FFN_{SwiGLU}(x, W, V, W_2) = (Swish_1(xW ) ⊗ xV )W_2 FFNGLU(x,W,V,W2)=(σ(xW)⊗xV)W2FFNBilinear(x,W,V,W2)=(xW⊗xV)W2FFNReGLU(x,W,V,W2)=(max(0,xW)⊗xV)W2FFNGEGLU(x,W,V,W2)=(GELU(xW)⊗xV)W2FFNSwiGLU(x,W,V,W2)=(Swish1(xW)⊗xV)W2

Experiments on Text-to-Text Transfer Transformer (T5)

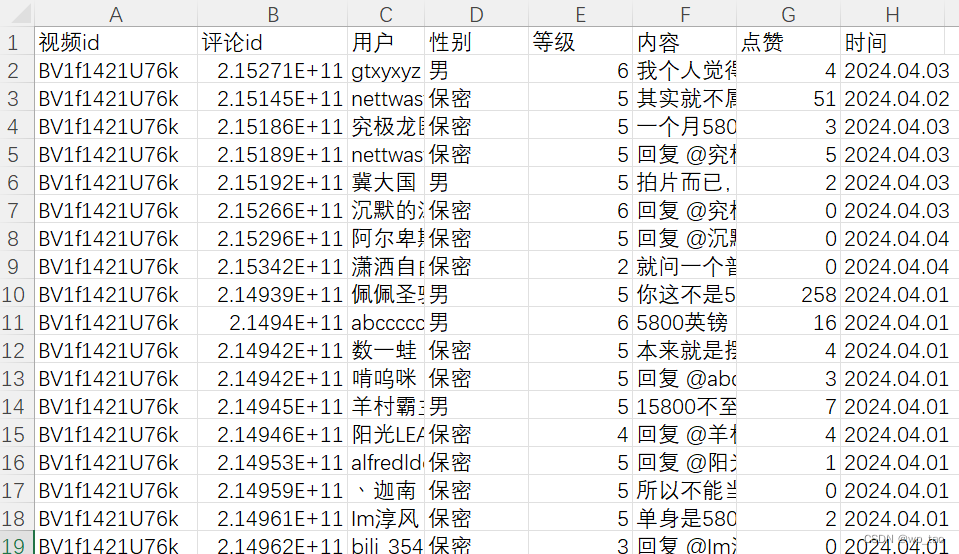

如图1,GEGLU和SwiGLU表现最好。

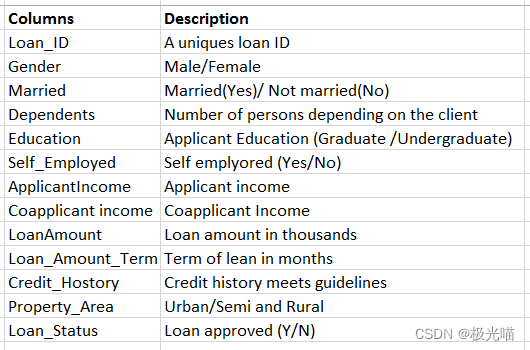

如图2,GLU家族表现最好。

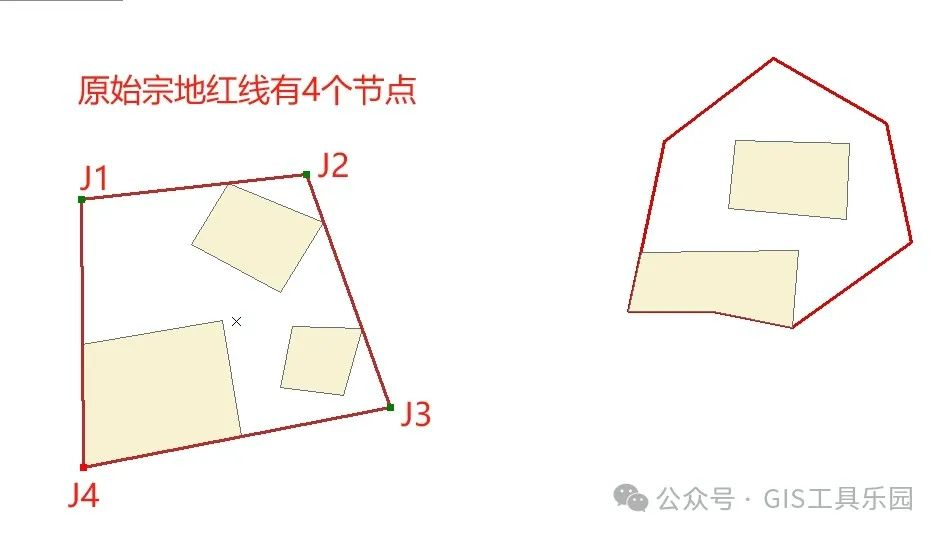

如图3,GLU家族表现最好。

Conclusion

【注】建议读下这部分的原文,乐死。以下是原段落:

We have extended the GLU family of layers and proposed their use in Transformer. In a transfer-learning setup, the new variants seem to produce better perplexities for the de-noising objective used in pre-training, as well as better results on many downstream language-understanding tasks. These architectures are simple to implement, and have no apparent computational drawbacks. We offer no explanation as to why these architectures seem to work; we attribute their success, as all else, to divine benevolence(上帝的仁慈).