微调方式

在大模型的下游应用中,可以有两种微调方式

- 增量续训

即无监督的方式,让模型学习一些新知识,比如某些垂直领域的新知识

使用的数据有:书籍,文章,代码等 - 有监督微调

为了让模型学会理解指令进行对话,或者注入少量的领域知识

使用的数据为高质量的对话和问答的数据

全量参数微调

部分参数微调 (lora等)

扩展上下文长度

必要性:

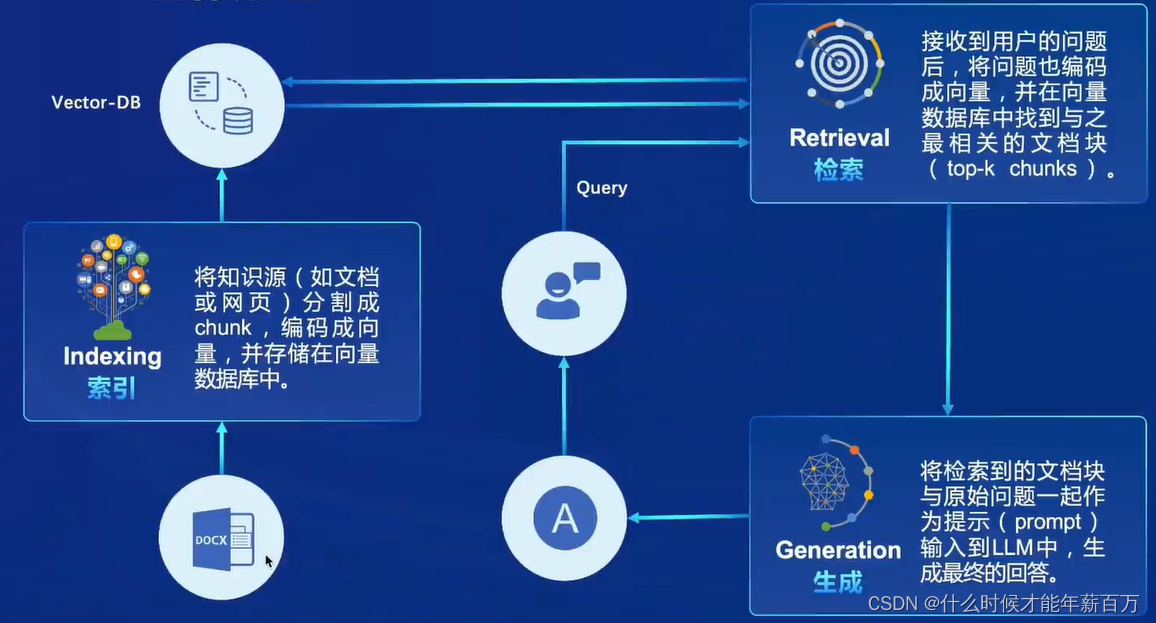

1. 检索增强生成(RAG)需要检索的时候返回很长的上下文

2. Agent应用时,用户的历史对话数据很长

LLaMA的transformer的更新

- 将 LayerNorm (Ba et al., 2016) 替换为 RMSNorm (Zhang & Sennrich, 2019)

- 将激活函数设置为 SwiGLU (Shazeer, 2020)

![[leetcode] 100. 相同的树](https://img-blog.csdnimg.cn/direct/50a32d2d308e4daf860535700e2b4a44.png)