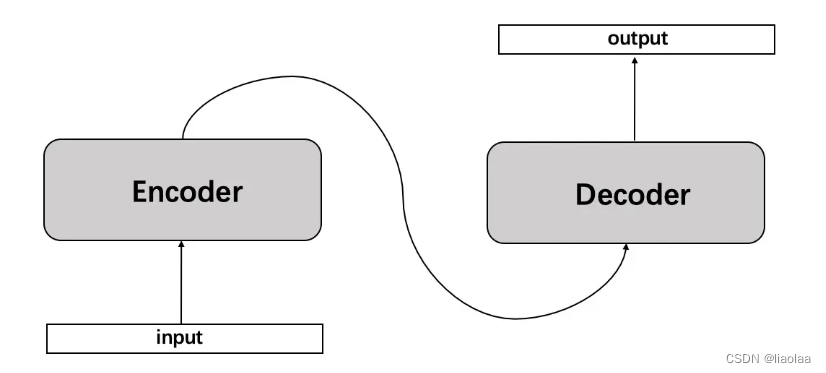

编码器-解码器结构在处理序列数据时之所以能够有效保存空间信息,是因为其设计特点特别适用于捕获和传递输入序列的上下文依赖性和潜在的空间结构。具体原因如下:

编码阶段的空间信息保留:

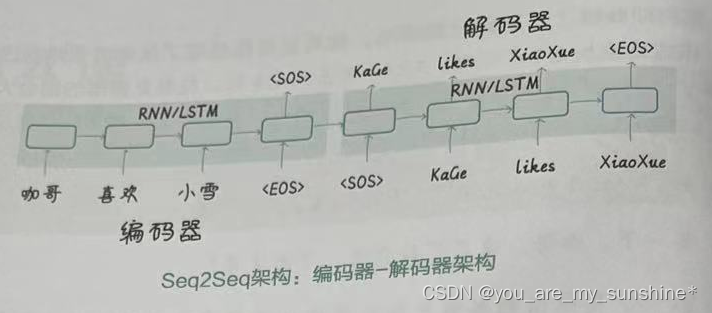

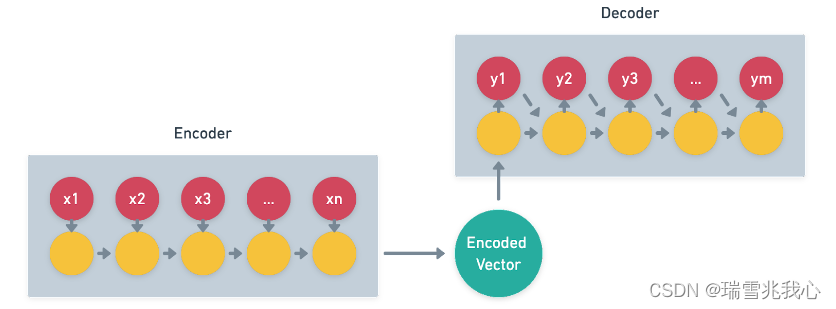

- 编码器通常采用循环神经网络(RNN,如LSTM或GRU)或Transformer结构,它们能够在处理序列数据时保持时间或位置上的顺序信息。

- RNN通过隐藏状态的递归更新捕捉到每个输入位置的信息,并通过门控机制(如LSTM中的遗忘门、输入门和输出门)选择性地记忆或忘记信息,确保重要的空间关系被保留下来。

- Transformer的自注意力机制通过自我关注层,不仅能够获取到序列内每个位置的信息,还能明确地考虑到任意两个位置之间的依赖关系,空间信息得以在整个序列中传播和聚合。

编码向量的综合表示:

- 编码器的最后一层输出或经过特定变换后的隐藏状态(例如,通过最大池化或求和等操作生成上下文向量)综合了整个输入序列的关键信息。

- 这个向量包含了输入序列的空间布局和语义特征,尽管它是一个固定维度的向量,但它通过非线性映射尽可能地压缩了输入序列的空间特性。

解码阶段的空间信息还原:

- 解码器同样具有捕获序列依赖性的结构,它利用编码器产生的上下文向量初始化自己的状态,并在生成输出序列的过程中逐次迭代。

- 在生成每一个输出元素时,解码器不仅考虑到了当前时刻的状态,还通过注意力机制回看编码器的输出,动态地聚焦到输入序列的不同部位,以便重构相应的空间信息。

总结起来,编码器-解码器结构能够有效地保存空间信息,主要体现在它可以捕捉序列中复杂的上下文关联,并通过特定的机制将这种关联信息以紧凑的形式编码在向量中,之后在解码阶段再将这些信息解码出来,从而在不同的任务(如机器翻译、图像描述生成、语音识别等)中重建或生成新的有序输出序列时保持原有的空间结构。