AI大模型学习

在当前技术环境下,AI大模型学习不仅要求研究者具备深厚的数学基础和编程能力,还需要对特定领域的业务场景有深入的了解。通过不断优化模型结构和算法,AI大模型学习能够不断提升模型的准确性和效率,为人类生活和工作带来更多便利。

方向一:AI大模型学习的理论基础

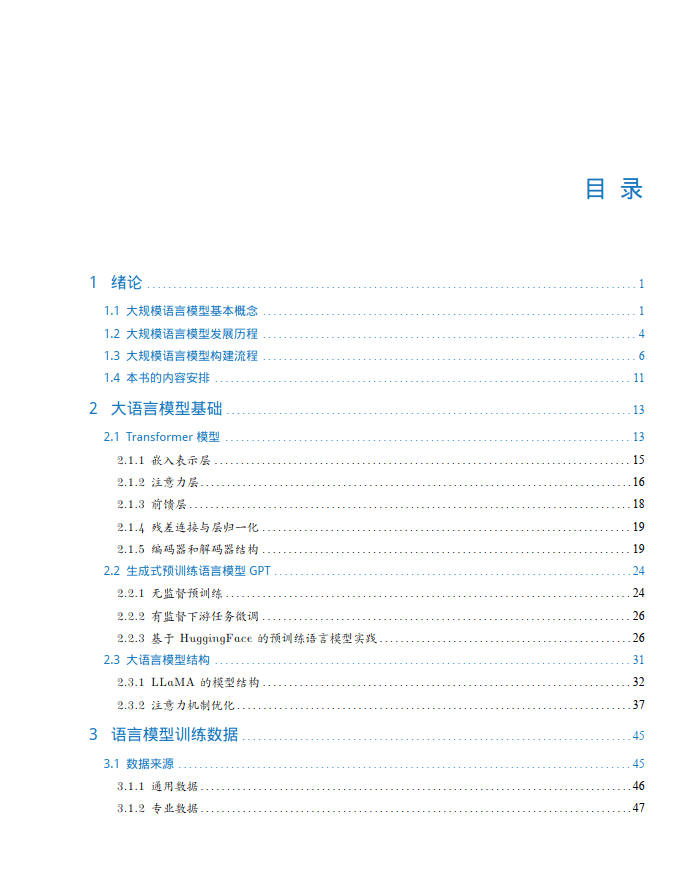

- 神经网络理论:神经网络是 AI 大模型的重要基础,它模拟了人类大脑的神经元结构和连接方式。神经网络通过调整神经元数量、连接方式和激活函数等参数来学习数据中的模式和特征。

- 深度学习理论:深度学习是基于神经网络的一种扩展,通过增加网络的层数和节点数量来提高模型的表达能力。深度学习中的卷积神经网络(CNN)和循环神经网络(RNN)等模型在图像识别、语音识别等领域取得了显著的成果。

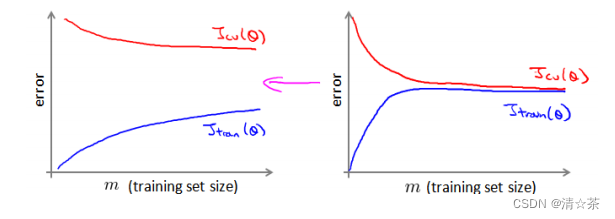

- 优化理论:AI 大模型的学习过程通常是一个优化问题,即通过调整模型的参数来最小化损失函数或最大化奖励函数。常见的优化算法包括随机梯度下降(SGD)、Adagrad、Adadelta 等。

- 概率论和统计学:概率和统计理论在 AI 大模型中用于建模不确定性和数据分布。例如,贝叶斯推理、概率密度函数和随机变量等概念在模型的训练和预测中起着重要作用。

- 信息论:信息论中的熵、信息增益等概念用于衡量数据的信息量和特征的重要性,有助于选择合适的特征和模型架构。

- 自动微分和梯度下降:自动微分技术使得在复杂的模型结构中计算梯度变得更加容易,从而实现高效的参数更新。

- 迁移学习和预训练模型:迁移学习理论允许模型在一个大规模的数据集上进行预训练,然后在其他任务或数据集上进行微调,以利用已有的知识和模型结构。

方向二:AI大模型的训练与优化

- 数据增强:通过对原始数据进行随机变换,如翻转、旋转、缩放等,增加数据的多样性,从而提高模型的泛化能力。

- 超参数调优:选择合适的超参数,如学习率、正则化参数等,通过网格搜索、随机搜索或基于模型性能的自适应调整来找到最优的超参数组合。

- 模型选择和架构搜索:比较不同的模型架构,如不同的神经网络结构或层的数量,以找到最适合特定任务的模型。

- 训练技巧:例如使用批量归一化、 Dropout、梯度裁剪等技术来改善训练过程和防止过拟合。

- 优化算法:选择合适的优化算法,如随机梯度下降(SGD)、动量 SGD、Adagrad 等,以加速训练过程和提高收敛性。

- 多模态数据融合:结合多种数据源,如图像、音频、文本等,以提供更全面的信息,提高模型的性能。

- 分布式训练:利用多个计算节点或 GPU 进行并行训练,加快训练速度。

- 模型压缩和量化:通过减少模型的参数数量或降低精度来减少模型的存储和计算需求,以便在资源有限的设备上部署。

- 监控和可视化:使用监控指标如损失函数、准确率等来跟踪训练过程,并通过可视化工具观察模型的中间结果,以便及时发现问题和调整策略。

- 迁移学习和预训练模型:利用在大规模数据上训练好的预训练模型,并在特定任务上进行微调,以节省训练时间和提高性能。

- 自动微分和梯度计算:利用自动微分工具自动计算模型的梯度,以便更高效地进行优化。

- 模型评估和选择:使用合适的评估指标和方法来比较不同模型的性能,并选择最优的模型。

这些技术和方法的具体应用取决于模型的特点、数据的性质和任务的要求。在实际训练过程中,通常需要进行实验和尝试,结合经验和领域知识来找到最适合的训练和优化策略。同时,不断的研究和创新也在推动新的方法和技术的发展,以提高 AI 大模型的性能和效率。

方向三:AI大模型在特定领域的应用

- 自然语言处理:大模型如 GPT-3 在文本生成、机器翻译、问答系统等方面取得了显著的进展。

- 计算机视觉:图像识别、目标检测、视频分析等任务可以通过大模型如卷积神经网络(CNN)来实现。

- 医疗保健:大模型可以用于疾病预测、药物研发、医疗影像分析等领域。

- 金融领域:风险评估、市场预测、欺诈检测等可以借助大模型进行分析和决策。

- 推荐系统:大模型可以根据用户的历史行为和偏好,为用户提供个性化的推荐。

- 智能交通:交通流量预测、自动驾驶等应用可以受益于大模型的能力。

- 工业制造:质量检测、故障预测、优化生产流程等方面可以利用大模型的智能。

- 教育领域:自适应学习、学生评估、智能辅导等应用可以通过大模型提供更个性化的教育体验。

方向四:AI大模型学习的伦理与社会影响

- 数据隐私和安全:大模型的训练需要大量的数据,这引发了数据隐私和安全的担忧。数据的收集、存储和使用需要遵循合法和道德的原则,以保护个人隐私。

- 算法偏见:模型的训练数据和算法可能存在偏见,导致不公平的结果或对某些群体的歧视。

- 就业和经济影响:自动化和智能系统的发展可能导致某些工作的转变或消失,同时也会创造新的就业机会和行业。

- 社会不平等:大模型的应用可能加剧社会不平等,因为获取技术和资源的机会可能不均匀分布。

- 道德责任和决策:AI 系统的决策可能对人类产生重大影响,因此需要明确道德责任和决策的框架。

- 透明度和可解释性:复杂的模型可能难以理解和解释其决策过程,这可能导致信任问题和决策的不确定性。

- 文化和价值观:模型的训练和应用可能受到文化和价值观的影响,需要考虑不同文化和价值观之间的差异。

- 公众意识和教育:提高公众对 AI 技术的理解和意识,以及进行相关的教育,对于应对其伦理和社会影响至关重要。

- 这些问题需要跨学科的研究和讨论,包括技术专家、伦理学家、社会科学家和政策制定者的共同努力。制定相关的法规和准则,进行伦理审查,以及促进公众参与和讨论都是应对这些挑战的重要举措。同时,持续的研究和监测也有助于及时发现和解决潜在的问题。AI 技术的发展应该遵循伦理和社会责任的原则,以确保其益处得到广泛共享,并最大程度地减少不利影响。

方向五:未来发展趋势与挑战

- 更强大的模型和性能提升:随着技术的进步,模型的规模和能力将继续增长,能够处理更复杂的任务和数据。

- 多模态学习:结合多种数据类型,如图像、音频和文本,进行综合学习和理解。

- 可解释性和透明度:提高模型的可解释性,使人们能够理解其决策过程和结果。

- 伦理和社会责任:解决数据隐私、算法偏见等伦理问题,确保 AI 的发展符合道德和社会价值观。

- 与人类的协作:AI 与人类的协作将变得更加紧密,共同解决复杂的问题。

- 泛化能力和适应性:提高模型在不同场景和数据中的泛化能力,使其能够更好地应对新的问题和变化。

- 能源和环境可持续性:考虑模型训练和运行的能源消耗,以及对环境的影响。

- 政策和法规:需要制定合适的政策和法规来引导 AI 的发展,确保其安全、可靠和可持续。

- 技术突破和创新:不断探索新的算法、架构和训练方法,以推动 AI 的进步。

这些发展趋势和挑战需要学术界、产业界和社会各方的共同努力。通过积极的研究、合作和政策制定,可以引导 AI 大模型的发展,使其为人类带来更多的益处,并应对可能出现的挑战。

![[CISCN2019 总决赛 Day2 Web1]Easyweb ----不会编程的崽](https://img-blog.csdnimg.cn/direct/1d45a89c19b1421ebc82fc6465a086f2.png)

![[leetcode]374. 猜数字大小](https://img-blog.csdnimg.cn/img_convert/4ecaead29eba0b15dbdfce9261bf0d3a.png)