数据并行(Data Parallelism)

内容:数据并行通过将训练数据分割成多个小批次,并在多个处理单元(如GPU)上同时训练模型的副本来工作。每个副本完成自己批次的前向和反向传播计算后,梯度被汇总并同步更新到所有模型副本。

优势:

- 易于实现和扩展。

- 可以显著减少训练时间,尤其是当模型较小,而数据集较大时。

缺点:

- 随着模型大小的增加,每个处理单元需要的内存也增加,可能受限于单个GPU的内存容量。

- 大规模时通信开销增大,可能成为瓶颈。

模型并行(Model Parallelism)

内容:模型并行涉及将模型的不同部分放置在不同的处理单元上。这对于单个模型参数太大,无法适配单个处理器的内存时尤为重要。

优势:

- 允许训练大型模型,超越单个处理单元内存限制。

- 模型的不同部分可以并行计算,提高效率。

缺点:

- 实现复杂,需要精心设计模型划分和跨处理单元的通信策略。

- 通信开销可能显著,特别是模型各部分间的依赖性强时。

流水线并行(Pipeline Parallelism)

内容:流水线并行将模型分成几部分(阶段),然后在不同阶段间流式传递数据进行训练,类似于工业生产线。

优势:

- 减少处理单元的空闲时间,提高资源利用率。

- 支持更大模型的训练,通过将模型分割到不同的处理单元上。

缺点:

- 可能引入复杂的同步问题,特别是当模型阶段的执行时间不均匀时。

- 流水线“冷启动”和“冷停止”阶段可能导致效率下降。

混合并行(Hybrid Parallelism)

内容:混合并行结合使用上述多种并行策略,以最大化计算效率和模型规模。

优势:

- 灵活地适应不同任务和计算环境的需求。

- 可以更高效地利用计算资源,同时训练更大的模型。

缺点:

- 实现和优化相对复杂,需要对不同并行策略有深入理

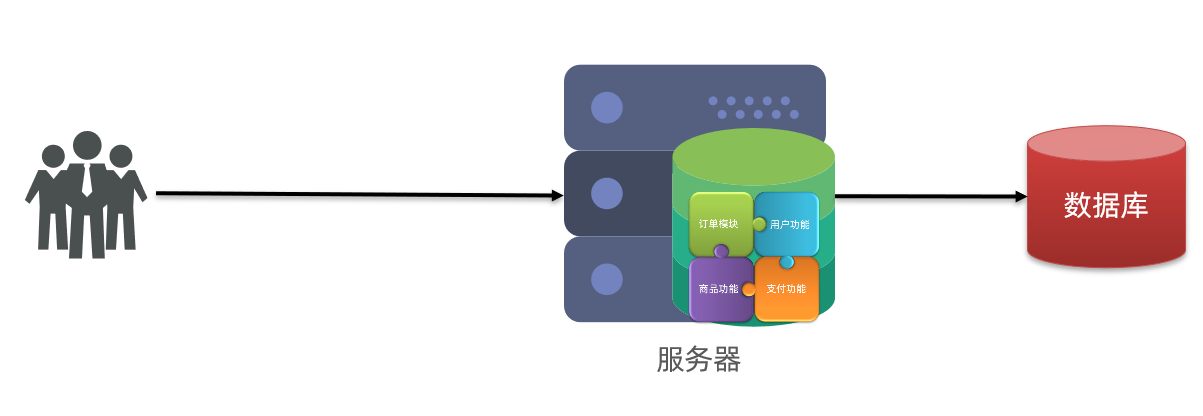

Mysql 的分布式策略

2024-03-23 20:34:02 8 阅读