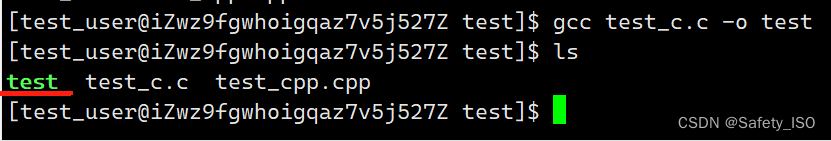

启动hadoop命令(未配环境变量):进入hadoop安装目录 输入./sbin/start-dfs.sh

已配环境变量:start-dfs.sh

关闭hadoop命令:stop-dfs.sh

启动完成后,可以通过命令 jps 来判断是否成功启动,若成功启动则会列出如下进程: "NameNode"、"DataNode" 和 "SecondaryNameNode"

三种Shell命令方式:

1.hadoop fs

2.hadoop dfs

3.hdfs dfs

hadoop fs适用于任何不同的文件系统,比如本地文件系统和HDFS文件系统

hadoop dfs只能适用于HDFS文件系统

hdfs dfs跟hadoop dfs的命令作用一样,也只能适用于HDFS文件系统

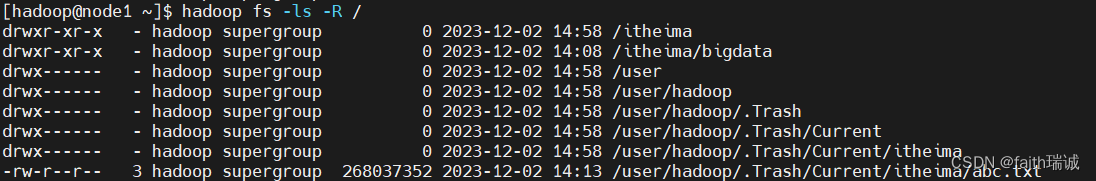

hdfs dfs -ls <path> 显示<path>指定的文件的详情信息

hdfs dfs -cat <path> 将<path>指定的文件的内容输出到标准输出(stdout),即终端

创建文件:hdfs dfs -mkdir [-p] <paths> 创建<paths>指定的一个或多个文件夹,-p选项用于递归创建子文件夹(创建多级目录用-p)

删除文件:hdfs dfs -rm [-r] <path> 删除<path>指定的文件夹及其下的所有文件,-r选项表示递归删除子目录(删除多级目录用-r)

复制文件:hdfs dfs -cp <src> <dst> 将文件从源路径<src>复制到目标路径<dst>

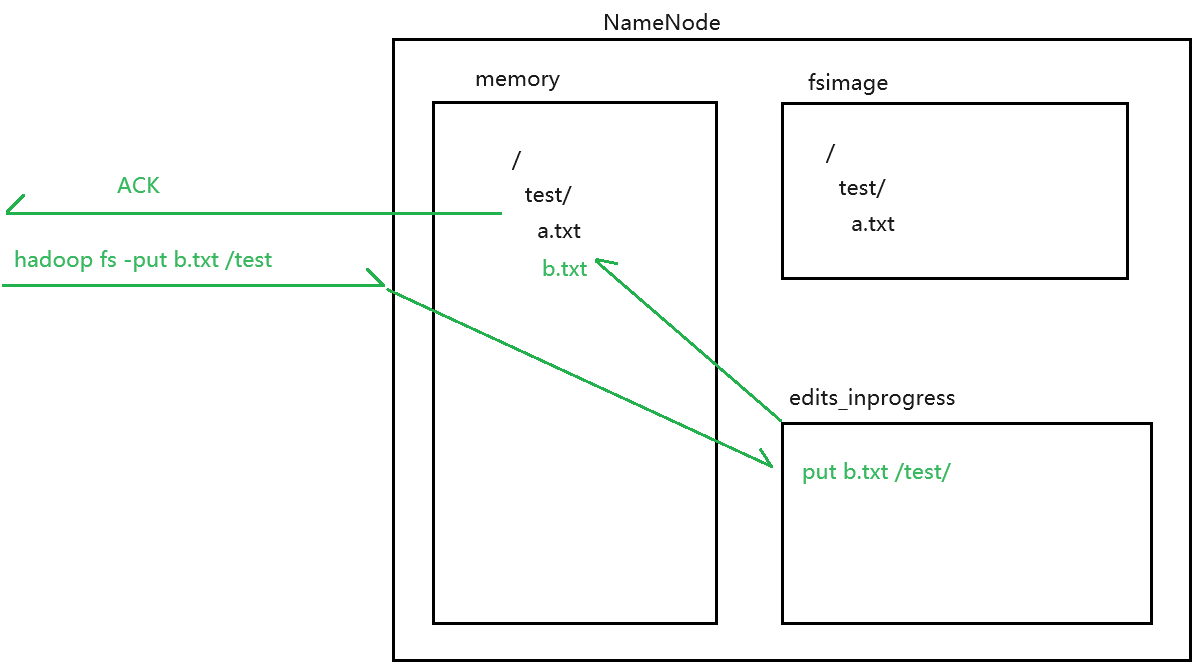

上传文件:hdfs dfs -put <localsrc> <dst> 从本地文件系统中复制<localsrc>指定的单个或多个源文件到<dst>指定的文件系统中

下载文件:hdfs dfs -get <src> <localdst> 复制<src>指定的文件到本地文件系统<localdst>指定的文件或文件夹

移动/重命名文件:hdfs dfs -mv <src> <dest> 将文件从源路径<src>移动到目标路径<dst>

复制文件(同-put):hdfs dfs -copyFromLocal <localsrc> <dst> 将本地源文件<localsrc>复制到路径<dst>指定的文件或文件夹中

覆盖:hdfs dfs -copyFromLocal -f 将本地源文件<localsrc>中的内容覆盖到路径<dst>指定的文件内容(不更改目的文件名)

追加:hdfs dfs -appendToFile 源文件 文件 将源文件中的内容追加到目标文件中

追加:echo "追加的内容" | hdfs dfs -appendToFile - /user/hadoop/ykb.txt 将输入的内容追加到指定的Hadoop中的txt文件中

导出jar包在Hadoop运行:hadoop jar 程序目录(hadoop jar ~/myapp/WordCount.jar) 将从eclipse中打包的运行程序使用hadoop jar命令在Hadoop上运行

可以通过浏览器登陆“http://[NameNodeIP]:9870”访问HDFS,其中[NameNodeIP]表示名称节点的IP地址

在浏览器网址栏输入localhost:9870进入HDFS的WEB界面