机器学习模型—Gradient Boosting

在当前的机器学习领域,Gradient Boosting算法凭借其卓越的性能备受推崇,并广泛应用于工业界和学术界。作为集成学习算法的杰出代表,Gradient Boosting将多个"弱学习器"有机结合,构建出极具预测力的强大模型。本文将揭开Gradient Boosting算法的神秘面纱,深入探讨其核心原理、实现细节以及实践经验。

GBDT 算法也叫梯度提升(Granding Boosting)算法,它是梯度下降和 Boosting 方法结合的产物。因为常见的梯度提升都是基于决策树模型(机器学习中就把决策树模型简称为树)的,所以我们这里会把它称作是 GBDT,即梯度提升决策树(Granding Boosting Decision Tree)。

梯度提升是机器学习中一种流行的提升算法,用于分类和回归任务。Boosting是一种集成学习方法,它顺序训练模型,每个新模型都尝试纠正以前的模型。它将多个弱学习器组合成强学习器。目前最流行的两种Boosting集成算法,即

- Adaboost

- Gradient Boosting

梯度提升

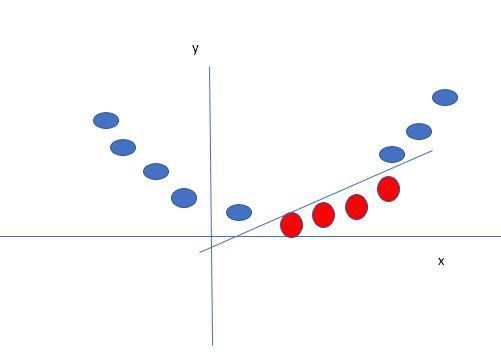

梯度提升是一种强大的提升算法,它将多个弱学习器组合成强学习器,其中每个新模型都经过训练,以使用梯度下降来最小化先前模型的损失函数,例如均方误差或交叉熵。在每次迭代中,该算法计算损失函数相对于当前集合的预测的梯度,然后训练一个新的弱模型以最小化该梯度。然后将新模型的预测添加到集合中,并重复该过程直到满足停止标准。

与AdaBoost相比,训练实例的权重没有调整

![[NSSRound#18 Basic]web解析](https://img-blog.csdnimg.cn/direct/ef2c936c6e46412caebb67d5f1117de1.png)