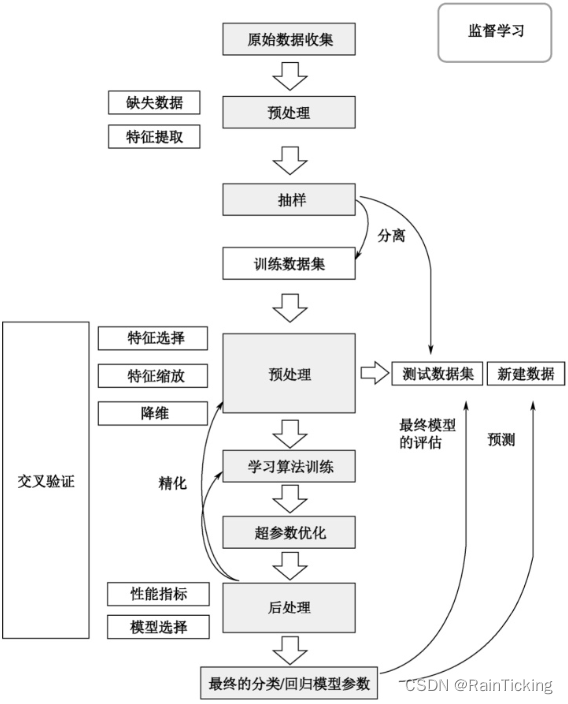

有监督算法

逻辑回归

逻辑回归是机器学习中一种经典的分类算法,通常用于二分类任务,基本思想是构建一个线性分类器并用sigmoid函数将线性输出转换为0-1之间的概率值,通过比较概率值来判断类别。训练过程中,常采用最大似然估计的方法对模型参数进行优化。

公式:

实际上就是套着回归模型的sigmod函数

优点:简单、计算量小

支持向量机SVM

SVM是一种二分类模型,旨在特征空间上寻找间隔最大化的分离超平面的线性分类器。

- 当训练样本线性可分时,通过硬间隔最大化,学习一个线性分类器,及线性可分SVM

- 当训练样本近似可分时,引入松弛变量,通过软间隔最大化,学习一个线性分类器

- 当训练样本不可分时,通过使用核技巧及软间隔最大化,学习非线性支持向量机

优点:分类速度快、泛化错误率低、结果易解释

缺点:对数据敏感、对核函数的选择敏感

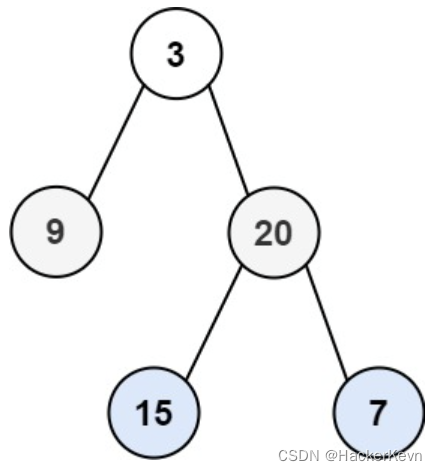

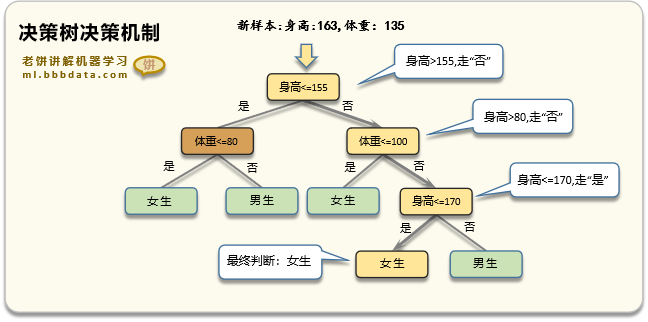

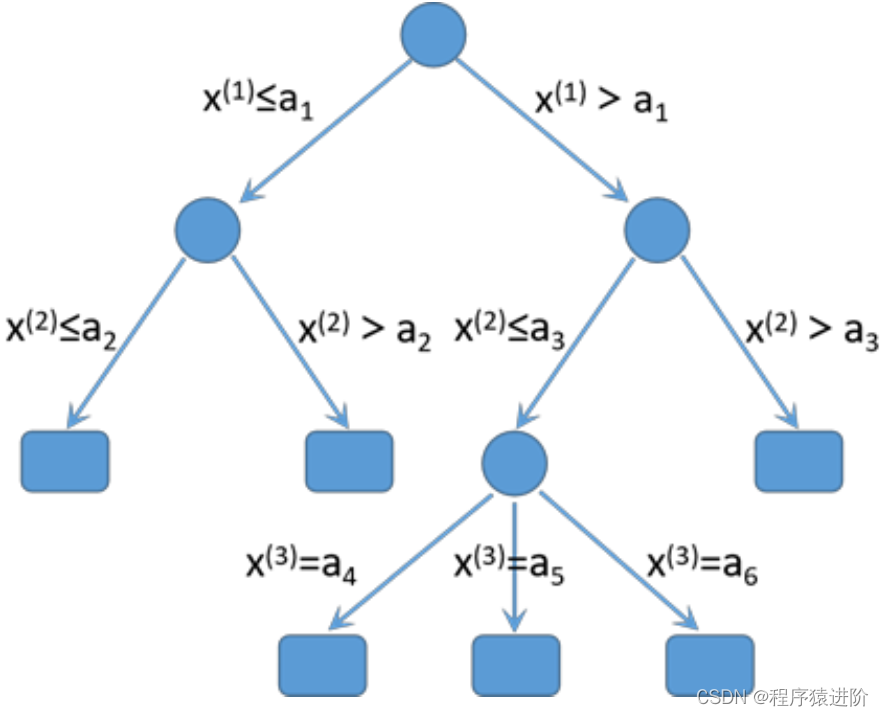

决策树

朴素贝叶斯

在给定一个事件发生的前提下,计算另外一个事件发生的概率

条件概率:P(A|B) = P(A,B) / P(B)

全概率:P(A) = 求和P(A|Bi) P(Bi)

K近邻(KNN)

无监督算法

K-means

PCA主成分分析

预留模版

SmartyPants将ASCII标点字符转换为“智能”印刷标点HTML实体。例如:

| TYPE | ASCII | HTML |

|---|---|---|

| Single backticks | 'Isn't this fun?' |

‘Isn’t this fun?’ |

| Quotes | "Isn't this fun?" |

“Isn’t this fun?” |

| Dashes | -- is en-dash, --- is em-dash |

– is en-dash, — is em-dash |

- 计划任务

- 完成任务

![[Spark SQL]Spark SQL读取Kudu,写入Hive](https://img-blog.csdnimg.cn/06e551a7a0d54922bff511126b300587.png)