目录

集成学习通过组合多个学习器来提高整体模型的预测性能,是机器学习中的一种重要策略。不同的集成学习方法有着各自独特的特点和适用场景。本文将深入探讨GBDT(Gradient Boosting Decision Tree,梯度提升决策树)与其他集成学习方法,如随机森林(Random Forest)和AdaBoost,的比较,旨在帮助读者更好地理解这些算法的优势和局限性,以及如何根据具体问题选择合适的算法。

写在开头

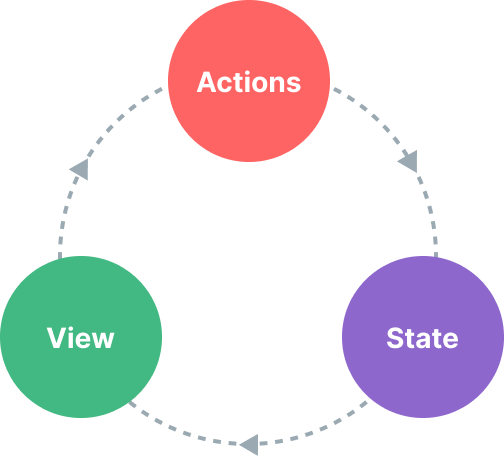

集成学习方法的多样性体现在它们采用不同的策略来构建和组合模型,以达到减少泛化误差的共同目标。这些方法通常被分为两大类:Bagging和Boosting,随机森林属于Bagging类,而GBDT和AdaBoost则属于Boosting类。尽管它们的最终目的相同,即通过集成多个弱学习器来提升模型的预测能力,但它们在模型构建和组合的具体方式上有所不同。

1. 主要集成学习算法对比

集成学习方法通过结合多个学习器的预测结果来提高整体模型的性能。在这一领域,GBDT(Gradient Boosting Decision Tree,梯度提升决策树)、随机森林(Random Forest)和AdaBoost是最为人熟知和广泛应用的算法。这些算法虽然共享集成学习的核心理念,但在其基本原理、特点以及适用场景上各有差异。

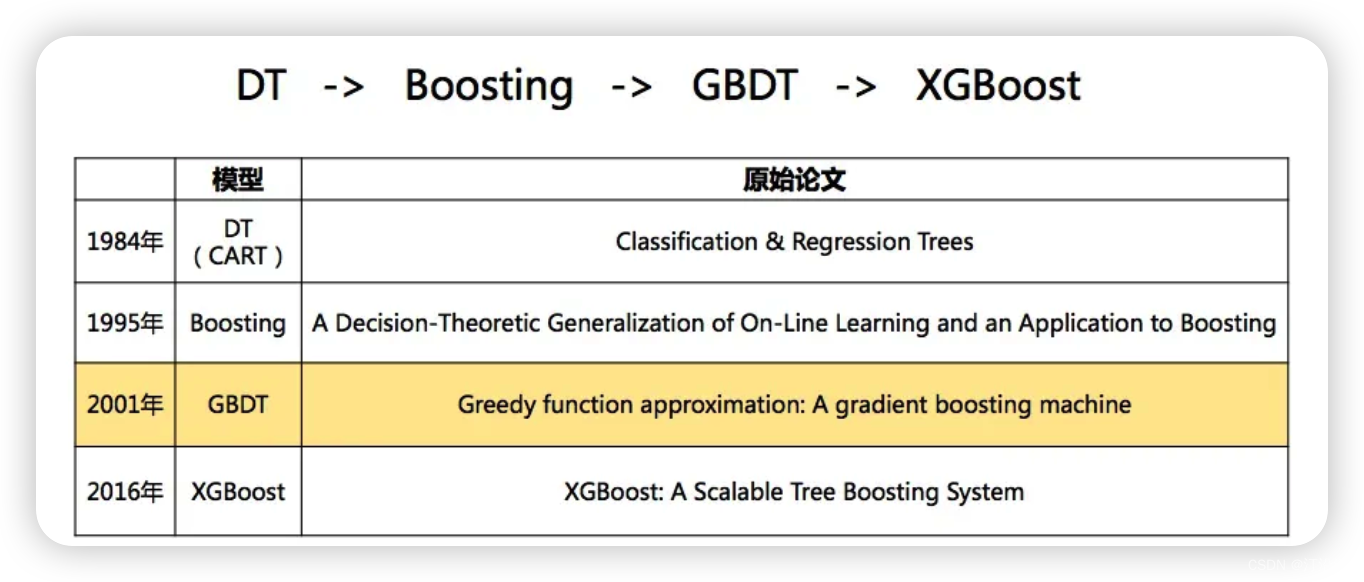

1.1 GBDT

基本原理

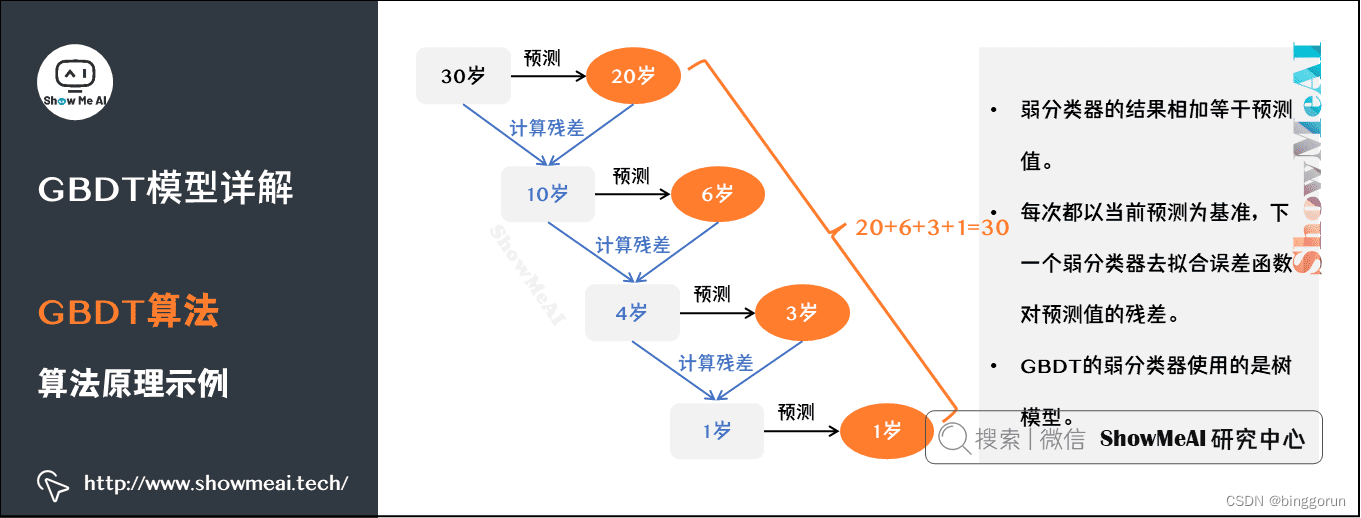

GBDT是一种Boosting算法,它通过逐步添加决策树,每棵新树都在尝试纠正前面所有树的残差,即前一棵树预测的误差。每次迭代中,GBDT都会使用梯度下降算法来最小化损失函数。

实现代码

from sklearn.ensemble import GradientBoostingClassifier

from sklearn.model_selection import train_test_split

from sklearn.