动态计算图与张量:

动态计算图是一种在运行时根据张量操作实时构建和更新计算流程的数据结构。在深度学习框架如PyTorch中,张量(Tensor)是基本的数据单元,它不仅存储数值数据,而且与计算过程紧密关联。当我们对张量进行数学运算(如加法、矩阵乘法、卷积等)时,框架会自动记录这些操作并形成一个临时的、随代码执行而变化的计算图,从而支持高度灵活且高效的深度学习算法实现。

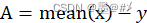

在这个动态计算图中:

- 节点:每个节点代表一次涉及张量的操作,例如一个矩阵乘法或激活函数应用。

- 边:边表示了数据流动的方向,即一个节点的输出张量作为另一个节点的输入张量。

- 前向传播:当模型接收输入数据并开始执行前向传播时,计算图随着每一步操作不断扩展和构建,直到得到最终的预测结果。

- 反向传播(Backpropagation)与梯度计算:当需要计算损失函数关于模型参数的梯度时,系统会沿着动态计算图自底向上进行反向传播,利用链式法则逐层累积梯度,并将这些梯度用于优化器更新模型参数。

这种动态构建计算图的方式使得模型能够灵活地适应不同的输入尺寸、形状以及条件分支结构,同时也简化了编程过程,开发人员无需预先定义整个计算图结构即可快速迭代和实验模型设计。

在深度学习框架如PyTorch中:

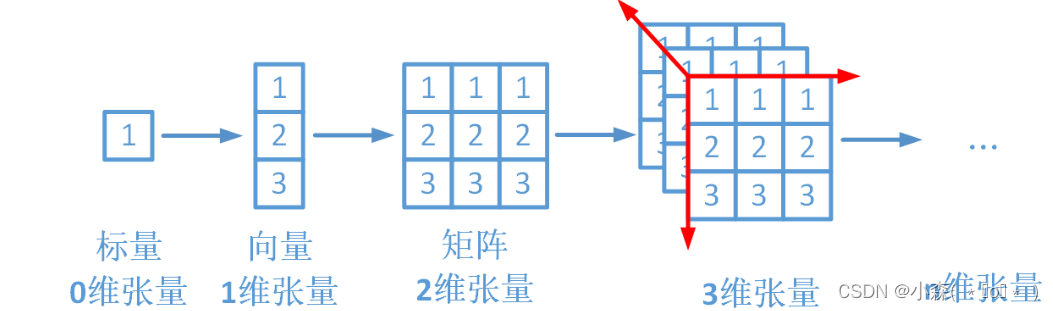

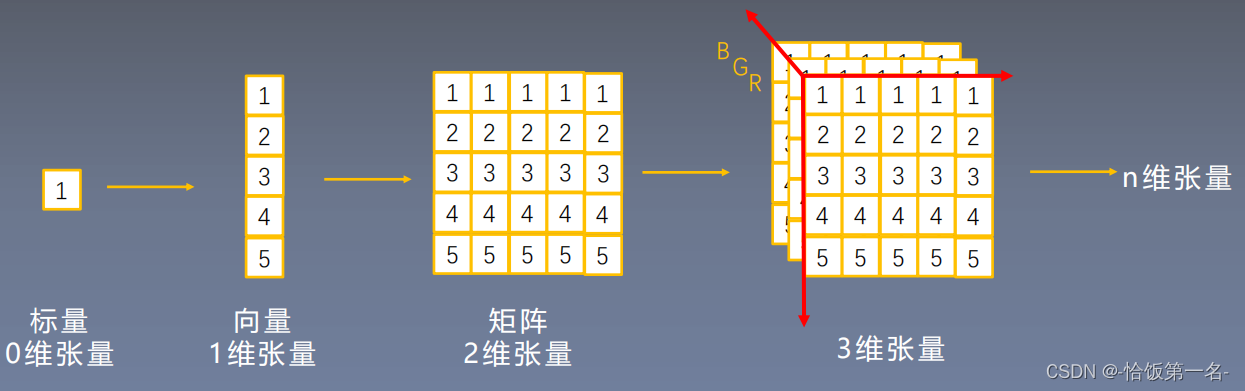

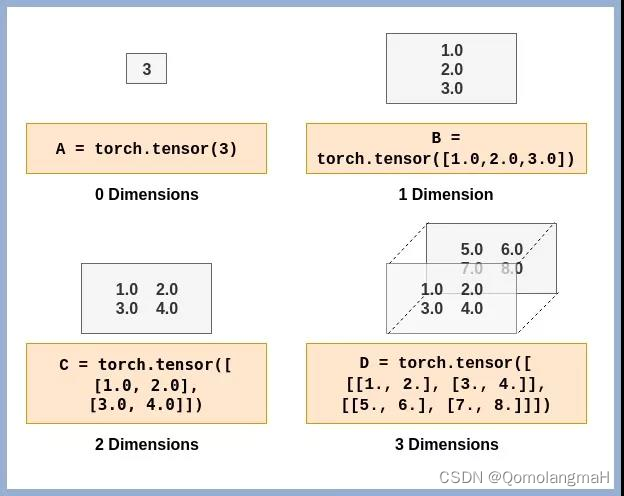

1.张量(Tensor):

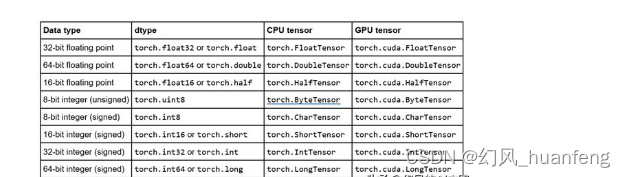

是PyTorch中的基本数据结构,用于存储数值数据,如图像、向量或矩阵等,并且可以在CPU或GPU内存上创建。当一个张量设置了requires_grad=True,表示它参与了可导的运算过程。任何基于这个张量的操作都会被记录到动态构建的计算图中。

2.计算图节点(Graph Node)

计算图实际上就是记录了所有涉及梯度计算的张量操作序列,每次对一个具有requires_grad=True属性的张量进行可微分运算时(例如加法、乘法、激活函数应用等),都会生成一个新的张量作为该运算的结果,并且这个新张量会作为一个新的节点添加到动态计算图中。每个节点代表一个数学运算(函数)。

3.边(Edges)

计算图中的边表示了节点之间的依赖关系,即输出张量对其输入张量的导数(梯度)。这种依赖性使得在反向传播过程中能够自动生成关于如何更新原始参数的梯度信息。而边则反映了数据流和依赖关系。

4.前向传播(Forward Propagation)

在前向传播过程中,模型会根据输入数据通过一系列层进行计算,并产生输出结果,同时计算图也在不断构建和完善。

5.反向传播(Backpropagation)

反向传播阶段,计算图发挥了关键作用:它允许系统按照构建时记录的顺序,自底向上地应用链式法则来计算每个参数相对于损失函数的梯度。当损失函数计算完毕后,通过调用.backward()方法启动反向传播过程。系统会根据动态构建的计算图从叶子节点(直接参与损失函数计算的张量)开始,逐层回溯求取所有上游节点的梯度。由于计算图是在运行时动态构建和管理的,因此模型可以灵活地改变计算流程,支持不同的前向传播路径,适应各种复杂的神经网络架构。

6. 自动求导(Automatic Differentiation)

这个自动求导的过程使得神经网络可以根据梯度信息来进行参数更新,从而优化模型性能。

总之,张量是计算的基本单元,在具备梯度需求时通过计算图这一抽象结构被组织起来,实现高效且灵活的自动微分机制,这对于训练深度学习模型至关重要。

![壹[1],Xamarin开发环境配置](https://img-blog.csdnimg.cn/direct/ff95e7746b6f4eb9bca08d919bfbb628.png)