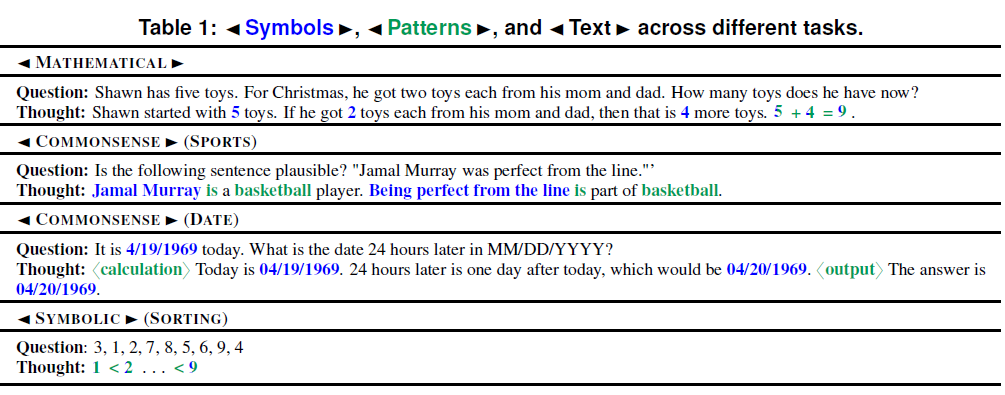

前置知识:RNN,LSTM

LSTM需要训练的参数很多,极消耗计算资源。GRU是一种LSTM的改进算法,参数更少,更容易训练。

它将忘记门和输入门合并成为一个单一的更新门,同时合并了数据单元状态和隐藏状态,使得模型结构比之于LSTM更为简单。

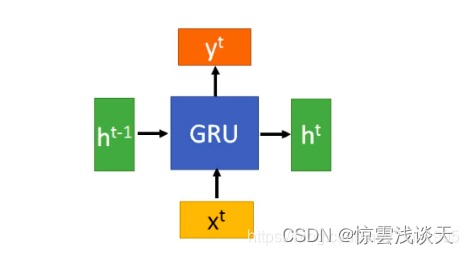

结构

GRU的整体结构图与RNN没有区别

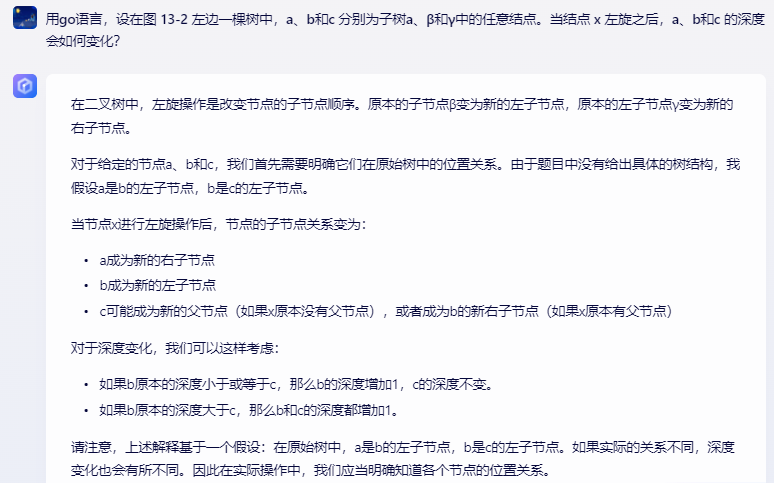

reset重置门

rt就是重置门,得到rt后,将rt与上一时刻传入的ht-1进行点乘,得到重置之后的数据,并与xt进行拼接。

h'包含了输入信息xt,经过选择后的上一时刻的信息h't-1,

update更新门

z*ht-1:表示对隐藏状态选择性的遗忘;

(1-z)*h':表示对包含当前节点信息的h'选择性的记忆

![Matlab技巧[绘画逻辑分析仪产生的数据]](https://img-blog.csdnimg.cn/direct/a3ba37bae3bb4bfe9dc1bfb936fa5b35.png)