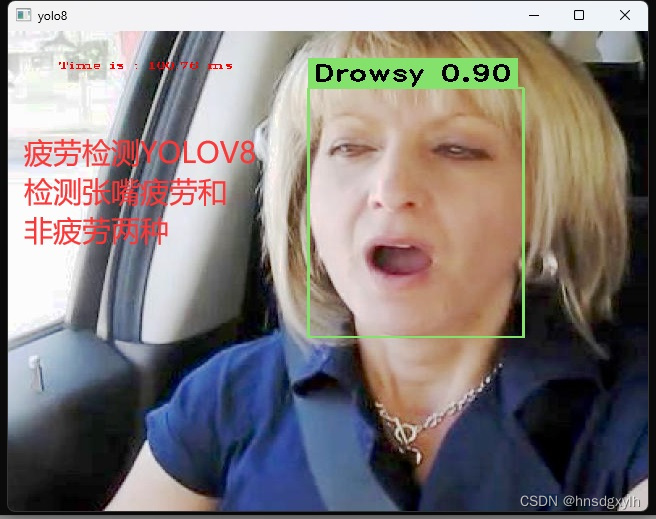

yolov8遗留物检测

遗留物检测(Abandoned Object Detection)是指在视频监控系统中识别和检测那些被放置或遗留在监控区域内且没有被取走的物体。这些物体可能是潜在的安全威胁,例如包裹、行李或其他可疑物品。

一、意义与应用

遗留物检测在许多领域和场景中都有重要意义,特别是在安全和监控方面。以下是其主要应用和意义:

反恐和防爆:在机场、火车站、地铁站等公共交通枢纽,遗留物检测可以帮助识别可能的爆炸物或危险物品,预防恐怖袭击。

大型活动:在体育赛事、音乐会等大型公共活动中,及时检测遗留物可以避免意外和恐怖袭击的风险。

- 无主行李识别:在机场、车站等场所,识别无人看管的行李,可以通知相关人员及时处理,防止丢失或被盗。

- 垃圾检测:在城市监控系统中,检测被遗弃的垃圾,及时通知清洁人员进行处理,维护城市环境卫生。

- 道路安全:在道路监控中,检测被遗弃的车辆或物体,及时清理以避免交通事故。

- 防盗:在商场或零售店中,检测被遗留的物品可以帮助识别潜在的盗窃行为或客户遗忘的物品,及时采取措施。

二、技术挑战

尽管遗留物检测具有广泛的应用前景,但其实现也面临一些技术挑战:

- 背景变化:监控场景中的光照变化、天气变化等都会影响背景建模的准确性。

- 遮挡问题:行人或其他移动物体遮挡住遗留物,导致检测失败。

- 物体分类:区分真正的遗留物和正常放置的物品需要更加智能的分类算法。

- 实时性:监控系统通常需要实时处理大量视频数据,如何在保证检测精度的同时提高处理速度是一个挑战。

三、相关技术

为了实现有效的遗留物检测,通常会结合以下技术:

- 背景建模:通过建模监控场景的背景,检测出前景中的变化部分。

- 运动检测:识别场景中静止和移动的物体,区分遗留物和正常的移动物体。

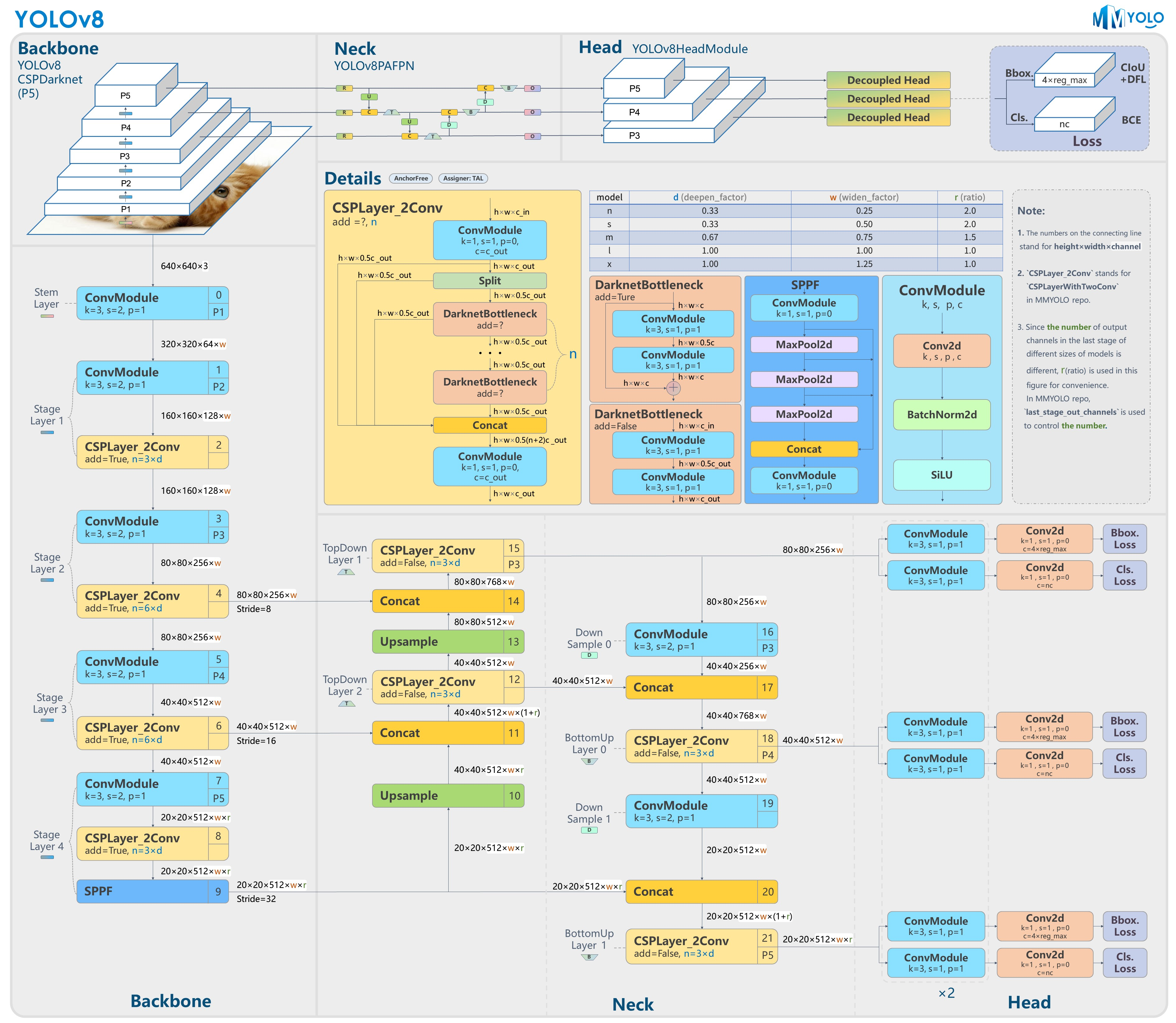

- 机器学习和深度学习:利用先进的模型(如YOLO等)进行物体检测和分类,提高检测的准确性和鲁棒性。

- 图像处理:利用图像差分、阈值处理、轮廓检测等技术提取前景物体。

四、前景提取和相关代码

提取前景是一项在计算机视觉和图像处理中的重要任务,尤其在运动检测、背景减法、视频监控等应用中尤为常见。前景提取的目的是从静止或动态背景中分离出感兴趣的活动对象。以下是几种常见的前景提取方法及其示例代码。

1. 基于背景减法的前景提取

背景减法(Background Subtraction)是前景提取最常用的方法之一。它通过建立背景模型,并将当前帧与背景模型进行比较,提取出前景物体。

import cv2

import numpy as np

# 创建背景减法器对象

backSub = cv2.createBackgroundSubtractorMOG2()

# 打开视频文件或摄像头

capture = cv2.VideoCapture("video.mp4") # 或者用摄像头: cv2.VideoCapture(0)

while True:

ret, frame = capture.read()

if not ret:

break

# 应用背景减法器

fgMask = backSub.apply(frame)

# 显示结果

cv2.imshow('Frame', frame)

cv2.imshow('FG Mask', fgMask)

# 按 'q' 键退出

if cv2.waitKey(30) & 0xFF == ord('q'):

break

capture.release()

cv2.destroyAllWindows()

2. 基于帧差法的前景提取

帧差法(Frame Differencing)通过计算连续帧之间的差异来提取运动前景。这种方法简单但对噪声敏感。

import cv2

import numpy as np

# 打开视频文件或摄像头

capture = cv2.VideoCapture("video.mp4") # 或者用摄像头: cv2.VideoCapture(0)

ret, frame1 = capture.read()

ret, frame2 = capture.read()

while True:

# 计算帧之间的差异

diff = cv2.absdiff(frame1, frame2)

# 转换为灰度图像

gray = cv2.cvtColor(diff, cv2.COLOR_BGR2GRAY)

# 应用阈值处理

_, fgMask = cv2.threshold(gray, 30, 255, cv2.THRESH_BINARY)

# 显示结果

cv2.imshow('Frame', frame2)

cv2.imshow('FG Mask', fgMask)

# 更新帧

frame1 = frame2

ret, frame2 = capture.read()

if not ret:

break

# 按 'q' 键退出

if cv2.waitKey(30) & 0xFF == ord('q'):

break

capture.release()

cv2.destroyAllWindows()

3. 基于高斯混合模型(GMM)的前景提取

高斯混合模型(Gaussian Mixture Model, GMM)是一种更高级的背景减法方法,它使用多个高斯分布来建模每个像素点的背景。

import cv2

import numpy as np

# 创建高斯混合模型背景减法器

backSub = cv2.createBackgroundSubtractorMOG2(history=500, varThreshold=16, detectShadows=True)

# 打开视频文件或摄像头

capture = cv2.VideoCapture("video.mp4") # 或者用摄像头: cv2.VideoCapture(0)

while True:

ret, frame = capture.read()

if not ret:

break

# 应用背景减法器

fgMask = backSub.apply(frame)

# 显示结果

cv2.imshow('Frame', frame)

cv2.imshow('FG Mask', fgMask)

# 按 'q' 键退出

if cv2.waitKey(30) & 0xFF == ord('q'):

break

capture.release()

cv2.destroyAllWindows()

4. 基于均值背景建模的前景提取

均值背景建模(Mean Background Modeling)是一种较简单的背景建模方法,通过计算每个像素点的均值来更新背景模型。

import cv2

import numpy as np

# 打开视频文件或摄像头

capture = cv2.VideoCapture("video.mp4") # 或者用摄像头: cv2.VideoCapture(0)

ret, frame = capture.read()

if not ret:

print("Failed to read video")

exit()

# 初始化背景模型

avg = np.float32(frame)

while True:

ret, frame = capture.read()

if not ret:

break

# 更新背景模型

cv2.accumulateWeighted(frame, avg, 0.01)

background = cv2.convertScaleAbs(avg)

# 计算前景掩码

diff = cv2.absdiff(frame, background)

gray = cv2.cvtColor(diff, cv2.COLOR_BGR2GRAY)

_, fgMask = cv2.threshold(gray, 25, 255, cv2.THRESH_BINARY)

# 显示结果

cv2.imshow('Frame', frame)

cv2.imshow('FG Mask', fgMask)

# 按 'q' 键退出

if cv2.waitKey(30) & 0xFF == ord('q'):

break

capture.release()

cv2.destroyAllWindows()

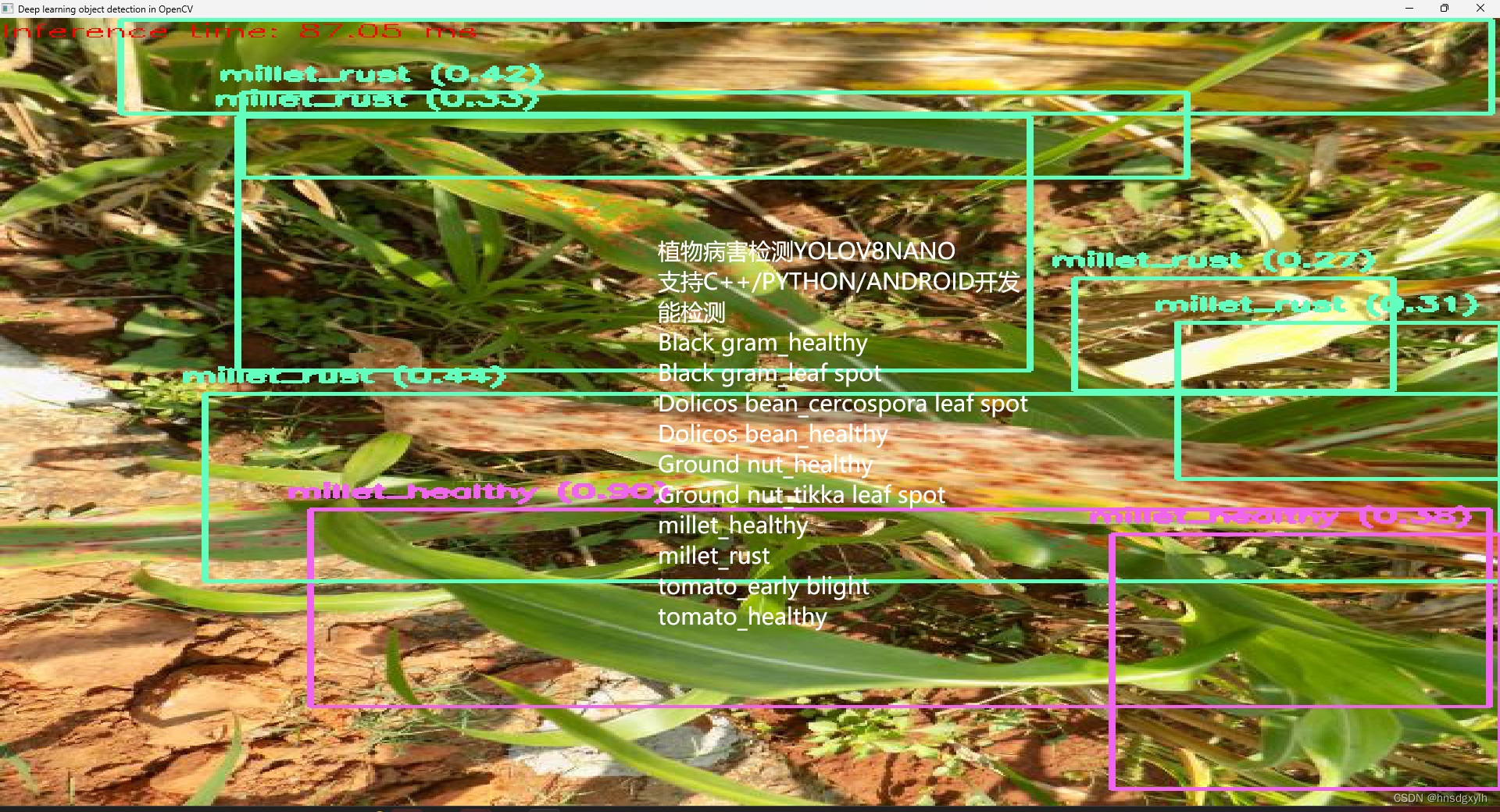

5.遗留物检测

conda activate yolov8 然后运行 python v8yiliu.py 即可。

遗留物体检测涉及的原理和技术:

1.背景建模与前景提取: 使用背景建模技术来检测静止物体。通过计算当前帧与背景帧之间的差异,提取前景物体。 计算当前帧与背景帧的差异,并通过阈值分割来提取前景。 函数动态更新当前背景帧,以适应场景中的变化。

2.跟踪检测物体: 通过跟踪检测到的物体位置和状态,管理检测框的生命周期。 每个检测到的物体及其状态信息(位置、帧计数、未检测计数等)。 当物体在多帧内未被检测到时,将其从跟踪列表中移除,以减少误报。

3.YOLOv8 行人检测: 使用 YOLOv8 模型进行行人检测,从视频帧中提取行人的边界框坐标。 如果在行人框内的前景目标,则舍弃,排除行人干扰。

4.前景绘制: 如果前景超过一定时间(遗留时间)即会进行标注中文标签,并画框。

yolov8遗留物检测代码分享:https://download.csdn.net/download/qq_34717531/89546394

![[米联客-安路飞龙DR1-FPSOC] FPGA基础篇连载-18 I2C MASTER控制器驱动设计](https://i-blog.csdnimg.cn/direct/63dc0072b2a143cbb5dec4330f11b57c.png)