概念介绍

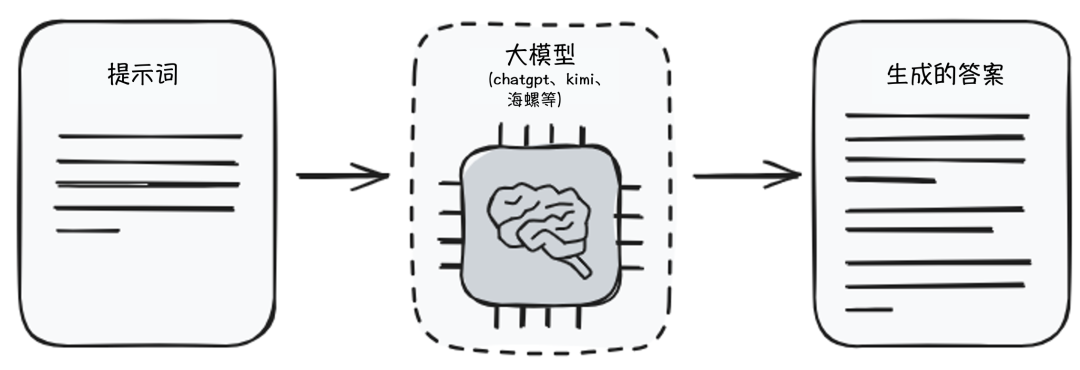

知识蒸馏(Knowledge Distillation)是一种将大模型(教师模型,Teacher Model)的知识传递给小模型(学生模型,Student Model)的技术。目标是通过训练学生模型,使其能够在较低的计算成本下达到接近教师模型的性能。

实现步骤

1. 教师模型和学生模型的选择

- 教师模型(Teacher Model):一个结合了知识图谱(KG)结构信息的大型预训练模型,例如基于图神经网络(GNN)的模型。

- 学生模型(Student Model):优化后的大规模语言模型(LLM),需要学习教师模型中的知识和推理路径。

2. 数据准备

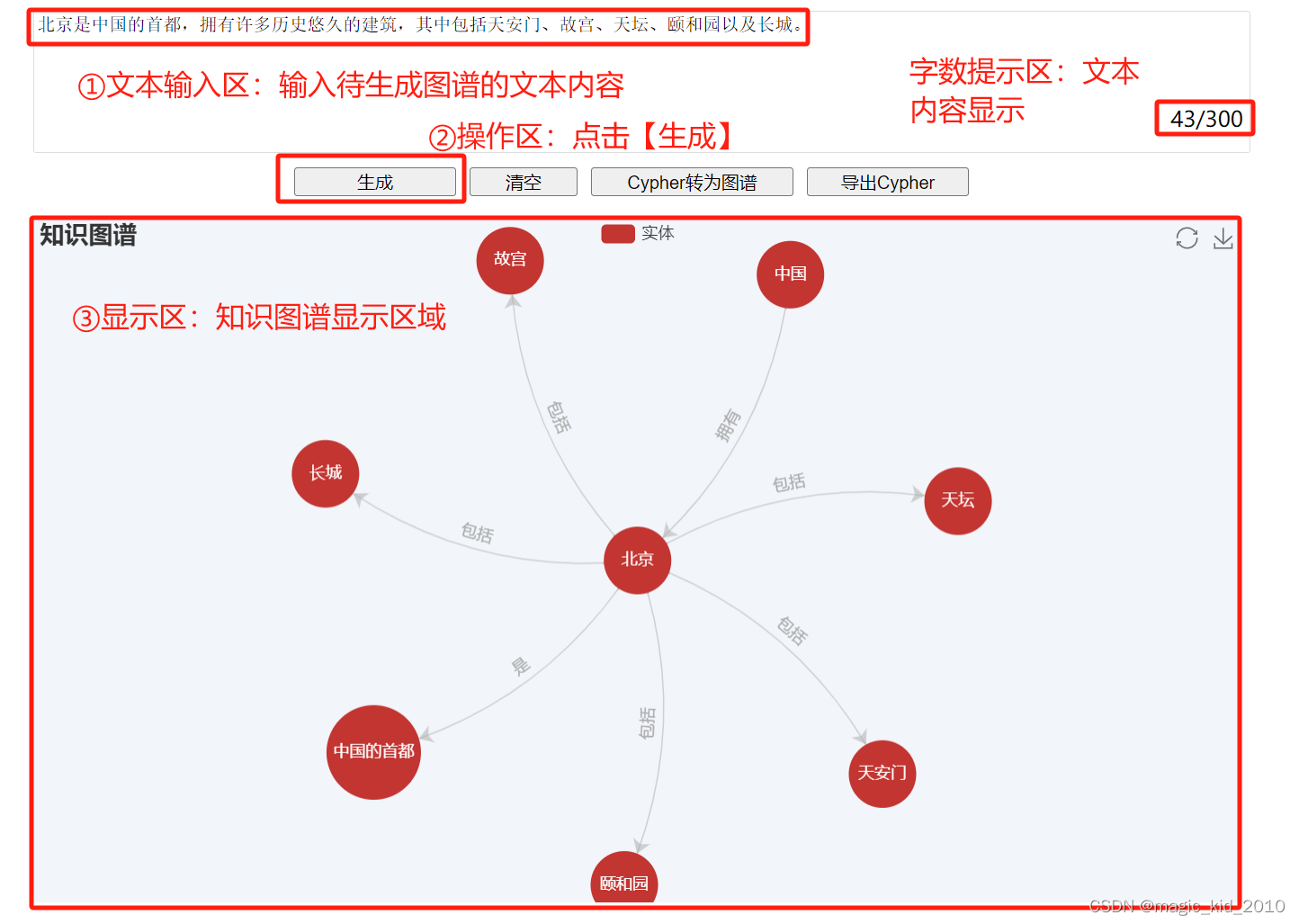

- 输入数据:问题和相关的知识图谱子图,包括问题中的实体和关系。

- 输出数据:教师模型生成的关系路径及其对应的推理结果。

3. 蒸馏过程

阶段一:教师模型推理

使用教师模型在给定的KG子图上进行推理,生成高置信度的关系路径和推理结果。例如,对于问题“Joe Biden的国籍是什么?”,教师模型可以生成路径:

- Joe Biden -> born_in -> Scranton -> city_of -> USA

阶段二:学生模型学习

通过优化学生模型,使其在给定相同输入时,生成与教师模型相似的输出。具体而言,通过最小化以下损失函数来训练学生模型:

L distill = α L hard + ( 1 − α ) L soft L_{\text{distill}} = \alpha L_{\text{hard}} + (1 - \alpha) L_{\text{soft}} Ldistill=αLhard+(1−α)Lsoft

其中,

- L hard L_{\text{hard}} Lhard 是学生模型生成的路径与真实路径(ground truth)之间的交叉熵损失。

- L soft L_{\text{soft}} Lsoft 是学生模型输出的软标签(soft targets)与教师模型输出的软标签之间的Kullback-Leibler散度。

- α \alpha α 是平衡这两部分损失的权重系数。

4. 模型优化

通过不断调整学生模型的参数,使其能够在保持较小模型规模的同时,生成准确的推理路径。在训练过程中,结合真实数据和生成数据进行联合训练,以提高模型的泛化能力。

具体应用示例

假设在训练过程中,教师模型生成了多个路径,如:

- Joe Biden -> born_in -> Scranton -> city_of -> USA

- Joe Biden -> graduate_from -> University of Delaware -> located_in -> USA

学生模型需要学习生成类似的路径,并在推理过程中,能够在知识图谱中找到并验证这些路径的正确性。

结论

通过知识蒸馏技术,可以将知识图谱中的丰富结构信息和复杂推理路径有效传递给大规模语言模型,增强其推理能力和准确性。这在大规模语言模型在实际应用中具有重要的意义,特别是在处理复杂推理任务时。

![[日进斗金系列]用码上飞解决企微开发维修管理系统的需求](https://i-blog.csdnimg.cn/direct/cf5c93d3edad4e819ca2194f83e7bd6c.png)

![[每周一更]-(第105期):SSL证书过期后引发的DNS缓存问题](https://i-blog.csdnimg.cn/direct/1a27bc675f38413f858aaa0be919e112.jpeg#pic_center)