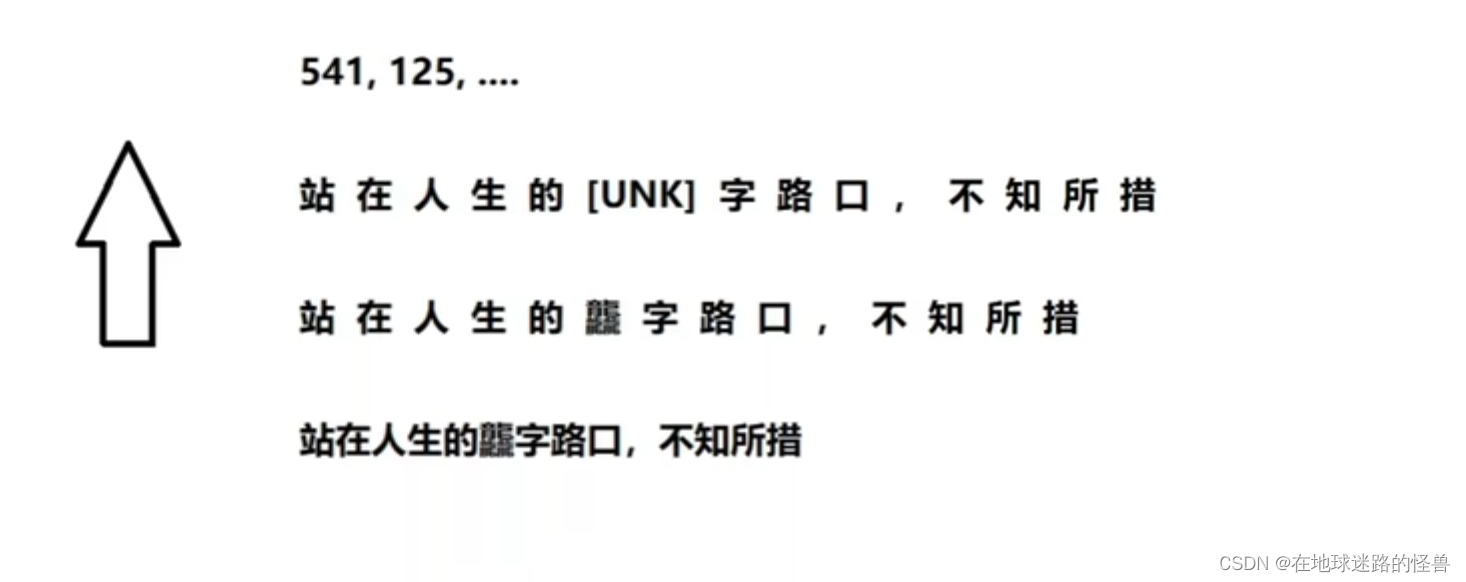

1,将文本转换为标记:

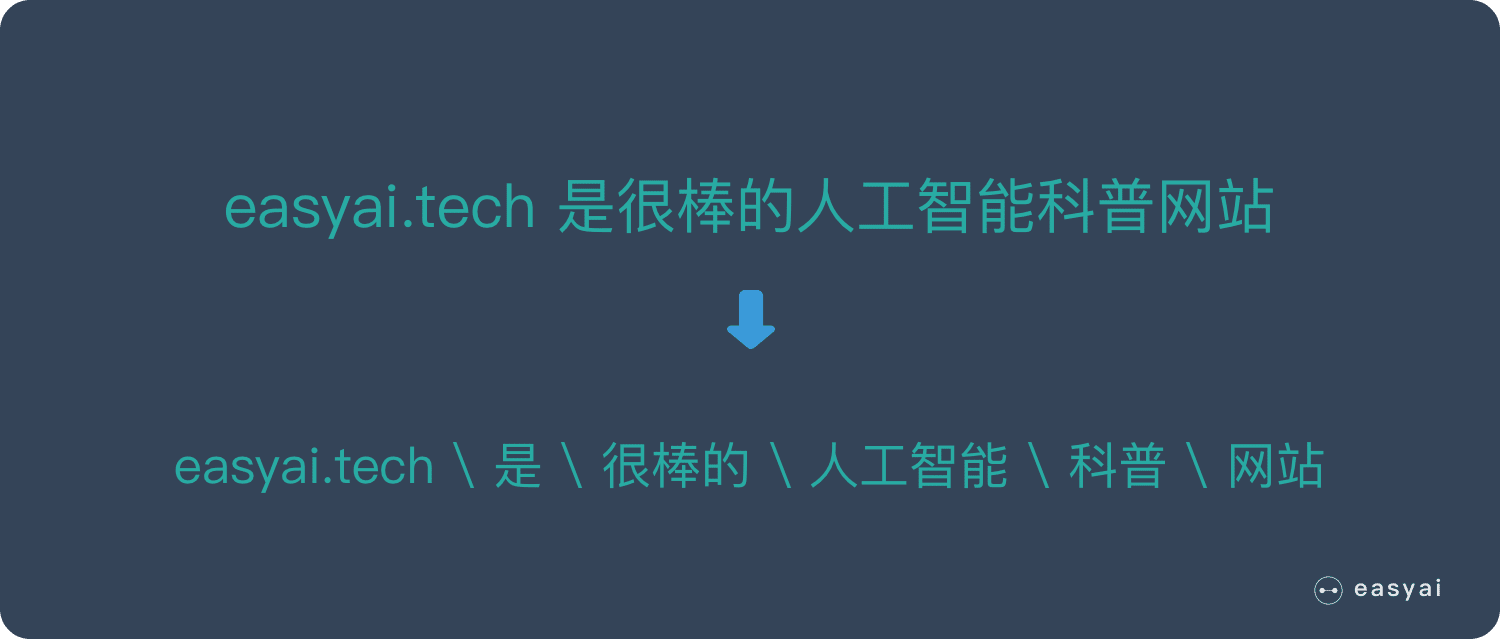

- 将输入文本分解成一系列标记(tokens),这些标记可以是单词、子词、字符等。

- 例如,句子 "Hello, world!" 可以被分解为 ["Hello", ",", "world", "!"]。

2,为模型准备输入:

- 生成的标记可以进一步转换为模型需要的格式,如索引序列、张量等。

- 例如,在词嵌入(word embeddings)模型中,标记可以映射到对应的嵌入向量。

class ExampleTokenizer: def __init__(self, vocab): self.vocab = vocab def tokenize(self, text): # 简单的基于空格的分词器 tokens = text.split() return tokens # 示例词汇表 vocab = ["hello", "world", "this", "is", "a", "test"] # 创建分词器实例 tokenizer = ExampleTokenizer(vocab) # 使用分词器进行分词 text = "hello world this is a test" tokens = tokenizer.tokenize(text) print(tokens) # 输出 ['hello', 'world', 'this', 'is', 'a', 'test']

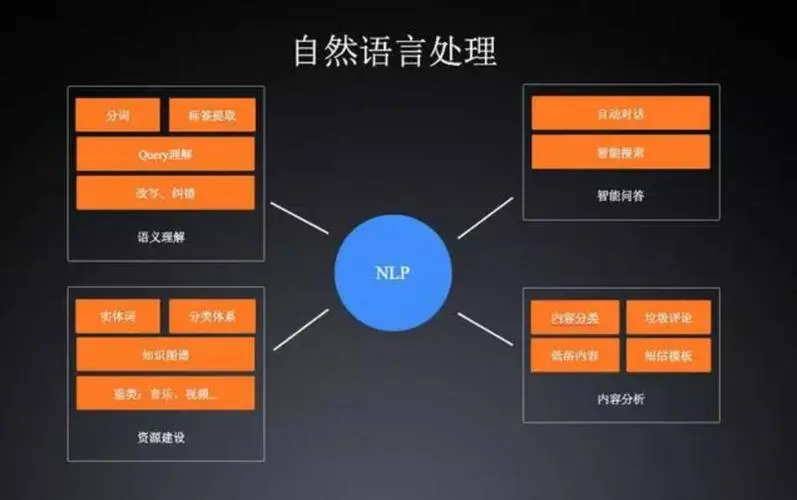

NLP中的Tokenizer分词器的概念与实现

2024-07-10 09:26:05 13 阅读