介绍: 在编程的世界里,爬虫技术无疑是一把打开数据宝库的钥匙。通过编写爬虫,我们可以自动收集互联网上的信息,从而进行数据分析、数据挖掘甚至是机器学习。但是利用python,一切可以很多简单,今天,我将与大家分享一个简单的Python爬虫实例,让我们一起迈出探索Python世界的第一步!

什么是爬虫?

爬虫,也称为网络爬虫或网页爬虫,是一种自动化的网络机器人。它的主要任务是访问网页,从中提取出我们需要的信息,并保存下来。这个过程就像是一只在互联网上爬行的小虫子,不断地搜集它感兴趣的“食物”。

为什么学习爬虫?

- 数据获取:在数据驱动的时代,掌握爬虫技术意味着你能够获取大量的原始数据,为后续的数据分析和决策提供支持。

- 编程实践:编写爬虫是一个很好的编程实践项目,可以帮助你巩固所学的编程知识,提高解决问题的能力。

- 技术挑战:网络世界的复杂性为爬虫编写带来了许多技术挑战,通过解决这些挑战,你的编程技能将得到显著提升。

简单爬虫实例:抓取虎牙直播的LOL游戏截图

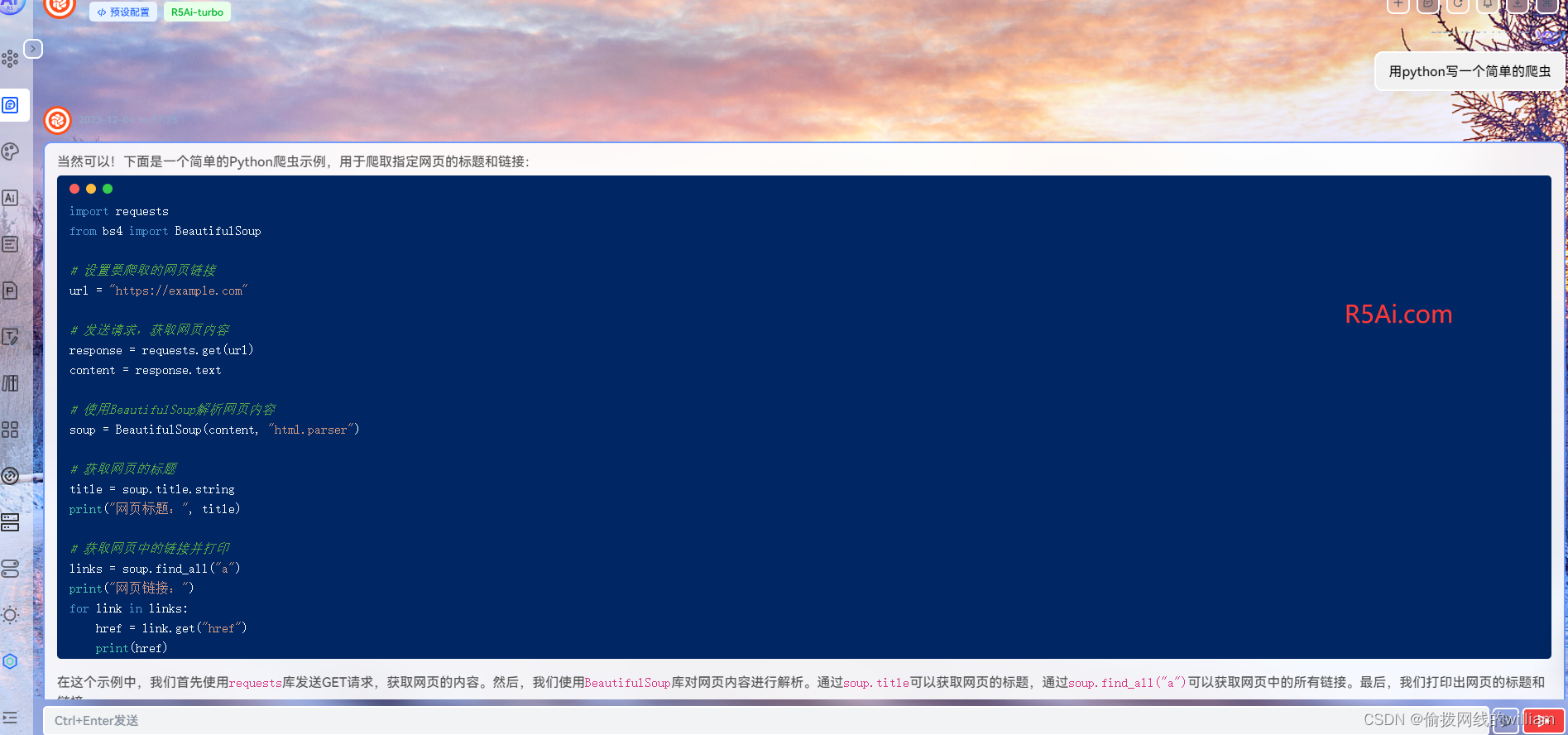

为了让大家更直观地感受爬虫的魔力,我们来看一个简单的例子:使用Python编写一个爬虫,抓取虎牙直播网站上的《英雄联盟》游戏截图。

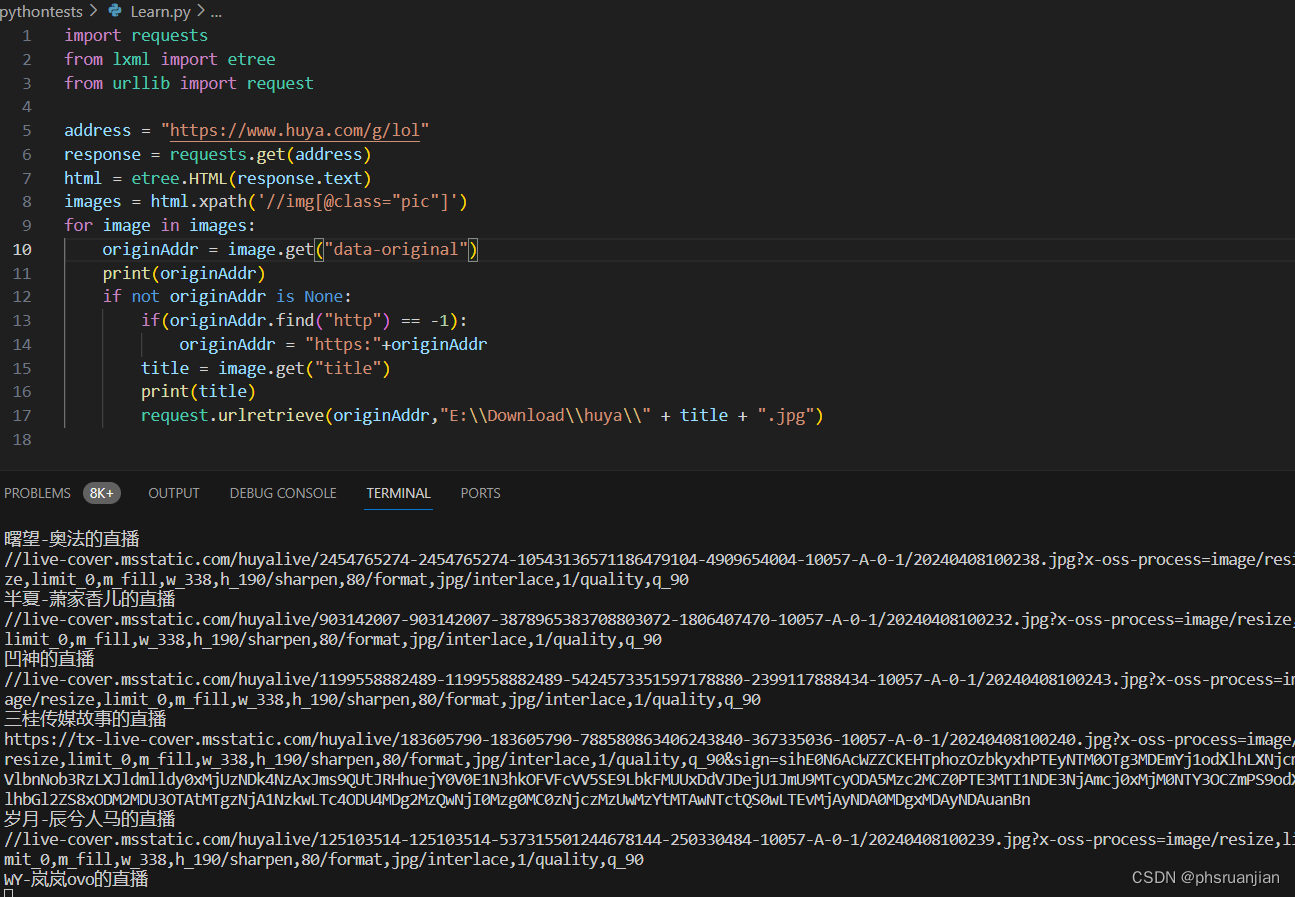

import requests

from lxml import etree

from urllib import request

address = "https://www.huya.com/g/lol"

response = requests.get(address)

html = etree.HTML(response.text)

images = html.xpath('//img[@class="pic"]')

for image in images:

originAddr = image.get("data-original")

print(originAddr)

if originAddr is not None:

if (originAddr.find("http") == -1):

originAddr = "https:" + originAddr

title = image.get("title")

print(title)

request.urlretrieve(originAddr, "E:\\Download\\huya\\" + title + ".jpg")这段代码首先使用requests库向目标网页发送请求,获取网页的HTML内容。然后,利用lxml库解析HTML,提取出所有包含游戏截图的<img>标签。对于每个截图,我们获取其原始地址,并检查是否为完整的URL。如果不是,我们将其补充完整。最后,使用urllib库将图片下载到本地指定的文件夹中。

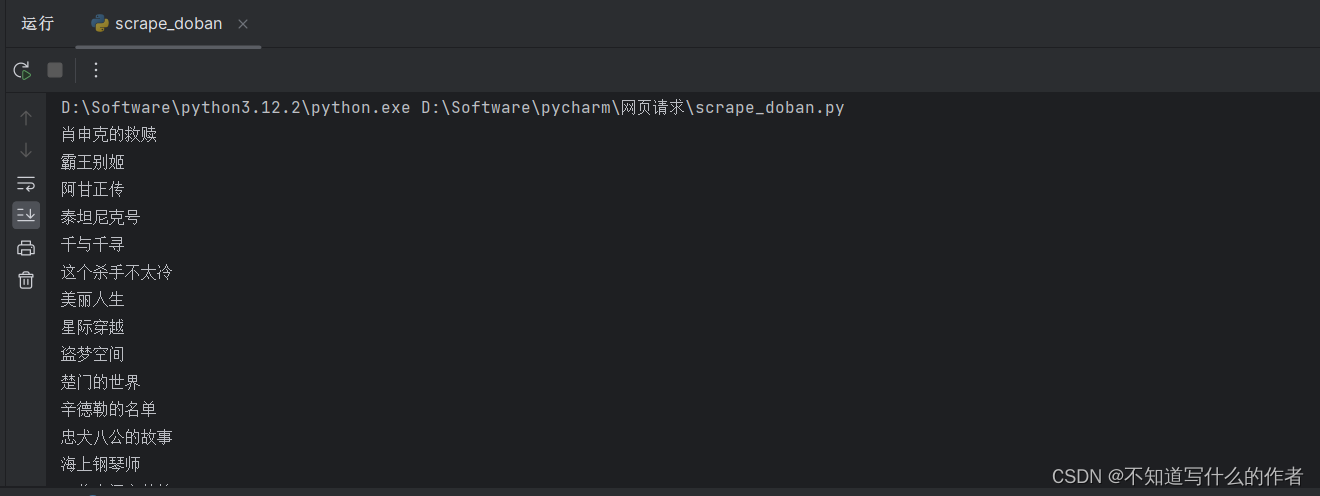

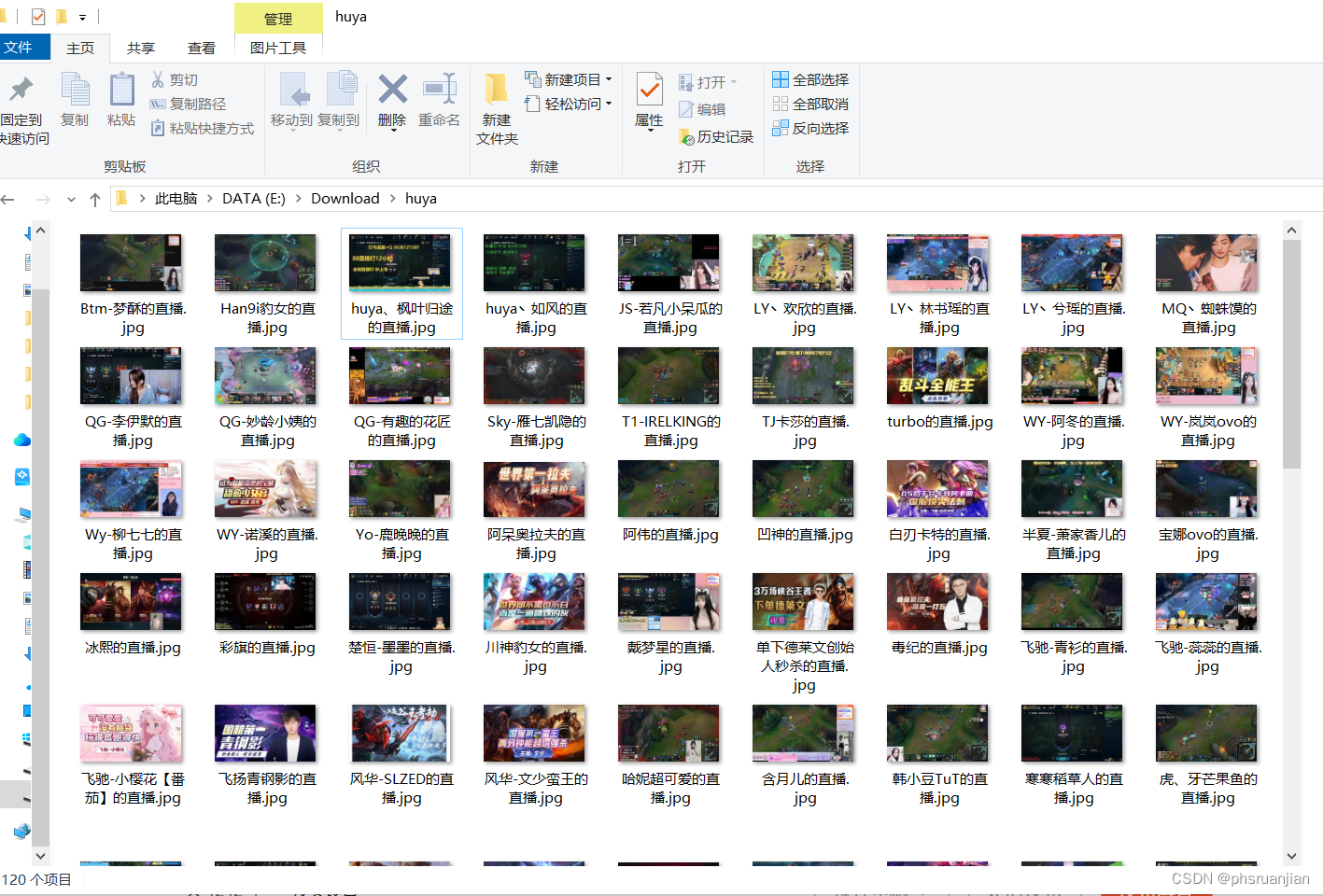

来看一看执行输出:

简单几行代码,我们爬到了120张图片,为未来数据分析,AI训练等工作做了奠基第一步。

结语

通过这个简单的例子,我们可以看到Python爬虫的强大与便捷。它不仅能够帮助我们快速获取网络上的信息,还能够激发我们对编程的兴趣和信心。随着你对Python的学习不断深入,你将能够编写更加复杂和强大的爬虫,探索更广阔的网络世界。让我们一起踏上这段充满乐趣和挑战的编程之旅吧!