机器学习模型—分类回归树(CART)

**CART(分类和回归树)**是决策树算法的一种变体。它可以处理分类和回归任务。Scikit-Learn使用分类和回归树 (CART) 算法来训练 决策树。CART 最初由 Leo Breiman、Jerome Friedman、Richard Olshen 和 Charles Stone 于 1984 年制作。

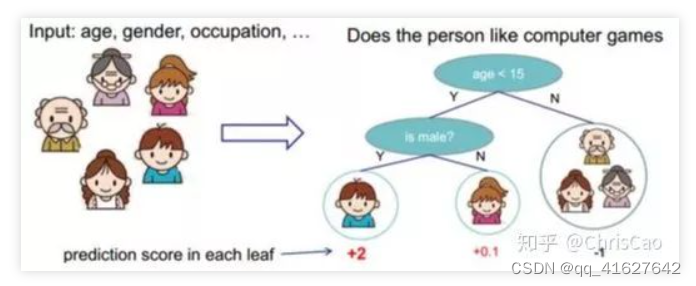

CART 是一种用于机器学习的预测算法,它解释了如何根据其他因素来预测目标变量的值。它是一棵决策树,其中每个分叉都分为一个预测变量,每个节点最后都有一个对目标变量的预测。

术语 CART 是以下类别决策树的通用术语:

- **分类树:**树用于确定目标变量在连续时最有可能落入哪个“类”。

- **回归树:**用于预测连续变量的值。

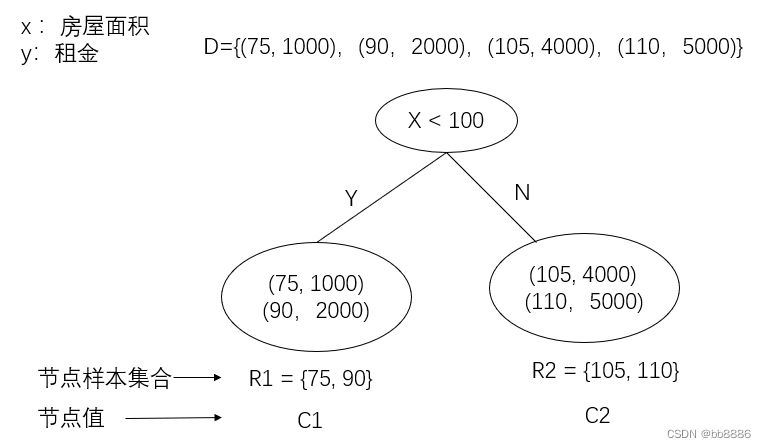

节点根据属性的阈值被划分为子节点。将根节点作为训练集,考虑最佳属性和阈值将其分为两部分。此外,还使用相同的逻辑来划分子集。这一直持续到在树中找到最后一个纯子集或在该生长的树中找到可能的最大叶子数。

CART算法

分类和回归树 (CART) 是一种决策树算法,可用于分类和回归任务。它是一种监督学习算法,可以从标记数据中学习来预测未见过的数据。

- 树结构: CART构建一个由节点和分支组成的树状结构。节点代表不同的决策点,分支代表这些决策的可能结果。树中的叶节点包含目标变量的预测类标签或值。

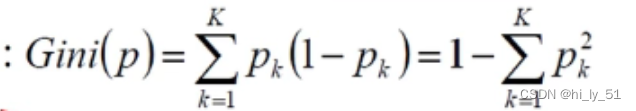

- 分割标准: CART使用贪心的方法在每个节点处分割数据。它评估所有可能的分割并选择最能减少结果子集的杂质的分割。对于分类任务,CART 使用基尼不纯度作为分割标准。基尼杂质越低,