引言

参考链接:https://github.com/datawhalechina/so-large-lm/tree/main

1.1 什么是语言模型

语言模型(LM) 的经典定义是⼀种对令牌序列(token)的概率分布。

从数学上讲,语⾔模型是⼀个⾮常简单⽽⼜美妙的对象。但是这种简单是具有欺骗性的:赋予所有序列以(有意义的)概率的能力,该能力要求语⾔模型具有非凡的(但是隐含的)语⾔能⼒和世界知识。

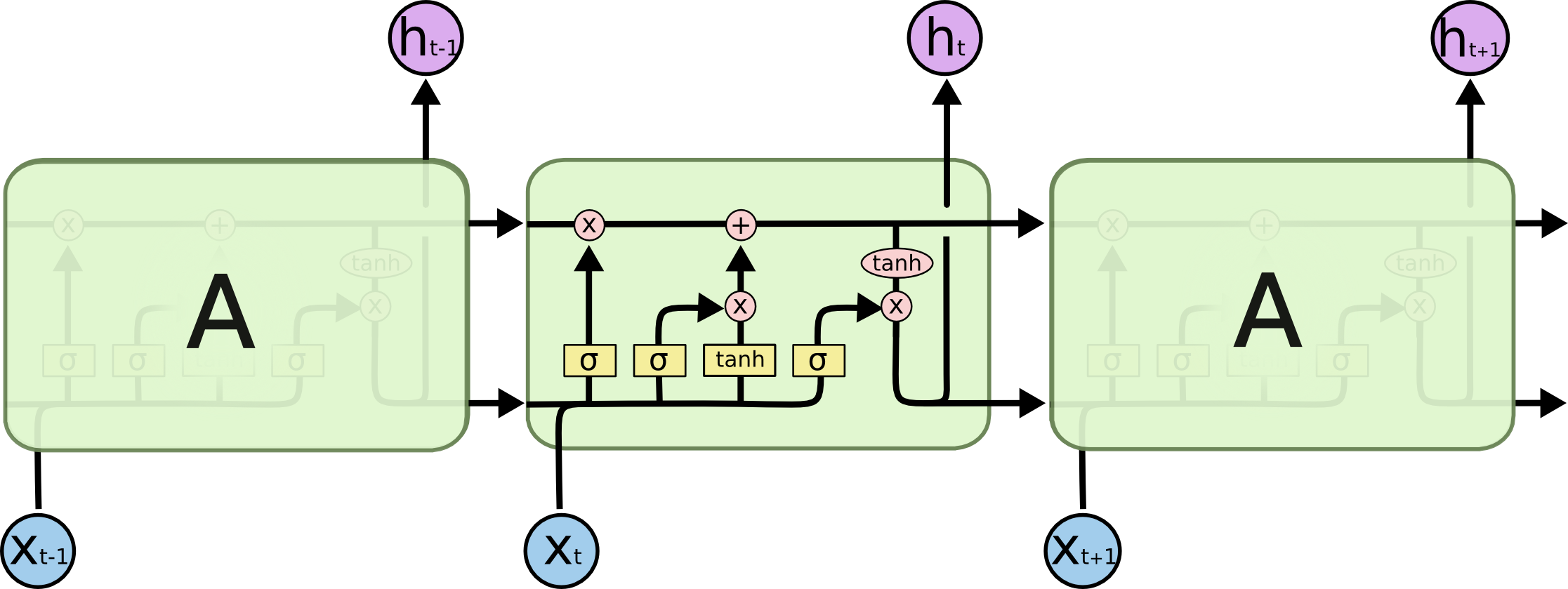

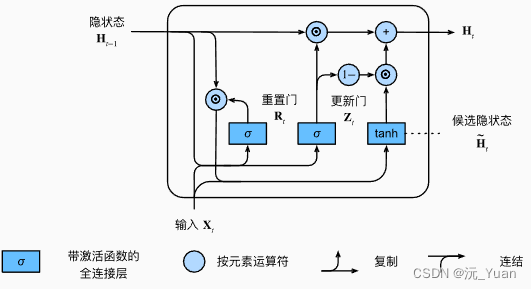

自回归语言模型(Autoregressive languagemodels) 的特点是它可以利⽤例如前馈神经⽹络等⽅法有效计算出每个条件概率分布p(xi|x1:i-1)。

1.2 大模型相关历史回顾

- 信息理论

语⾔模型的发展可以追溯到克劳德·⾹农,他在1948年的具有⾥程碑意义的论⽂《通信的数学理论》中奠定了信息理论的基础。熵实际上是⼀个衡量将样本x~p 编码(即压缩)成⽐特串所需要的预期⽐特数的度量。熵的值越⼩,表明序列的结构性越强,编码的⻓度就越短。 - 英语的熵

⾹农特别对测量英语的熵感兴趣,将其表示为⼀系列的字⺟。这意味着我们想象存在⼀个“真实”的分布p(这种存在是有问题的,但它仍然是⼀个有⽤的数学抽象),它能产⽣英语⽂本样本x∼p。 - n-gram模型

语⾔模型⾸先被⽤于需要⽣成⽂本的实践应用:

1970年代的语⾳识别(输⼊:声⾳信号,输出:⽂本)

1990年代的机器翻译(输⼊:源语⾔的⽂本,输出:⽬标语⾔的⽂本)

噪声信道模型。当时解决这些任务的主要模型是噪声信道模型。

1.3 这门课的意义

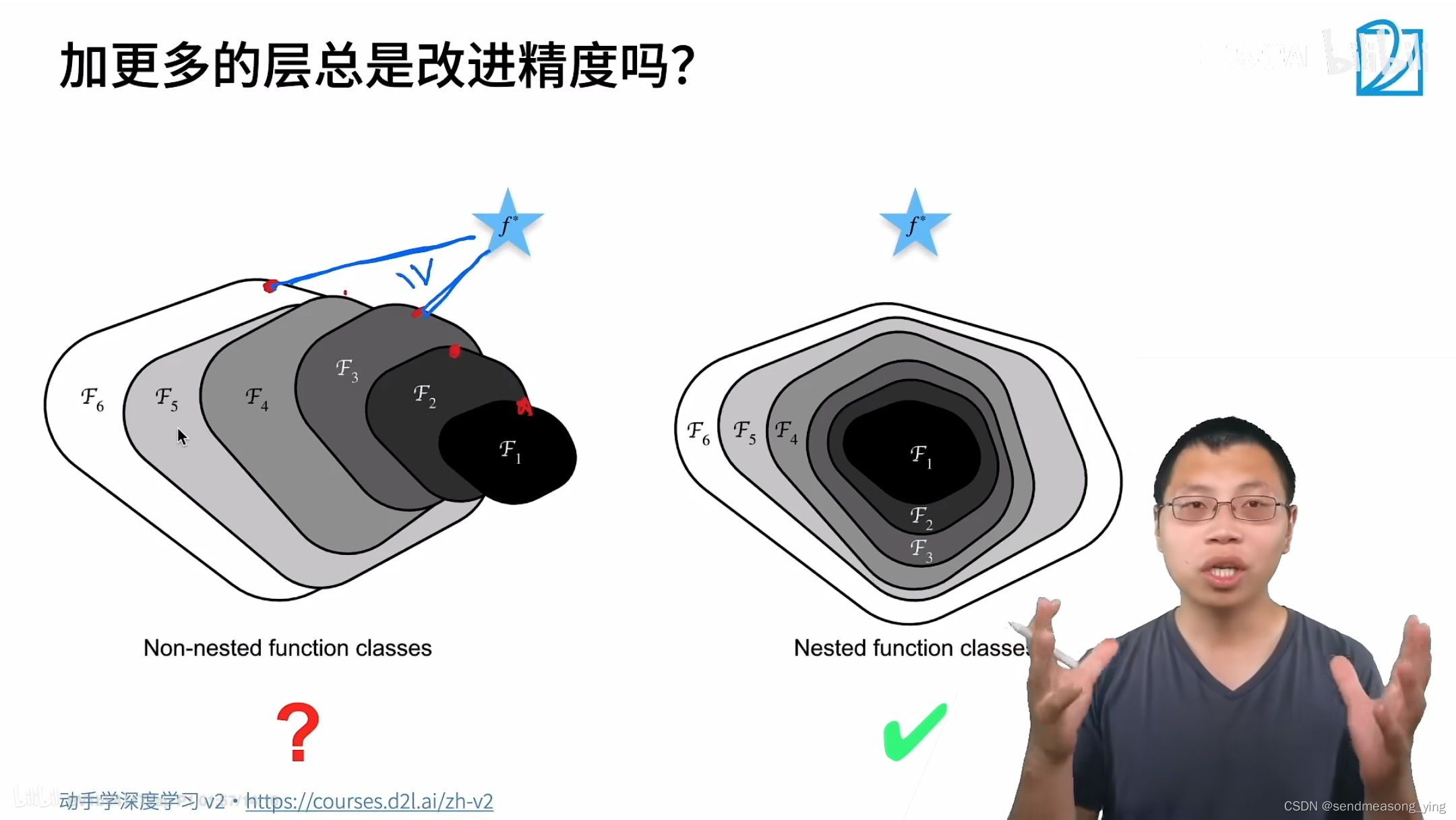

所谓的“⼤型”是指什么?随着深度学习在2010年代的兴起和主要硬件的进步(例如GPU),神经语⾔模型的规模已经⼤幅增加。在过去4年中,模型的⼤⼩增加了5000倍。

尽管很多技术细节是相同的,令⼈惊讶的是,“仅仅扩⼤规模”就能产⽣新的出现⾏为,从⽽带来定性上不同的能⼒和定性上不同的社会影响。

1.4 总结

单⼀的⼤型语⾔模型是⼀个万事通(也是⼀⽆所⻓)。它可以执⾏⼴泛的任务,并且能够具备上下⽂学习等新出现的⾏为。

⼤型语⾔模型仍然存在许多重要的⻛险,这些⻛险是开放的研究问题。

![[go] 单例模式](https://img-blog.csdnimg.cn/direct/15f376692e92497ea6b440218442e92b.png)