笔记整理:方润楠,浙江大学硕士,研究方向为自然语言处理

链接:https://arxiv.org/abs/2305.09144

摘要

近年来,大规模预训练语言模型展示出惊人的记忆能力,相比之下,未经预训练的普通神经网络存在着灾难性遗忘的问题。为了研究这种记忆与遗忘出现的原因,并探求语言模型的记忆机制,作者通过控制模型类别,学习策略,知识分布等方面进行了全面实验。作者发现:1)普通语言模型容易遗忘;2)预训练能够使语言模型记忆力变强;3)知识相关性和多样性会影响记忆形成。

总体介绍

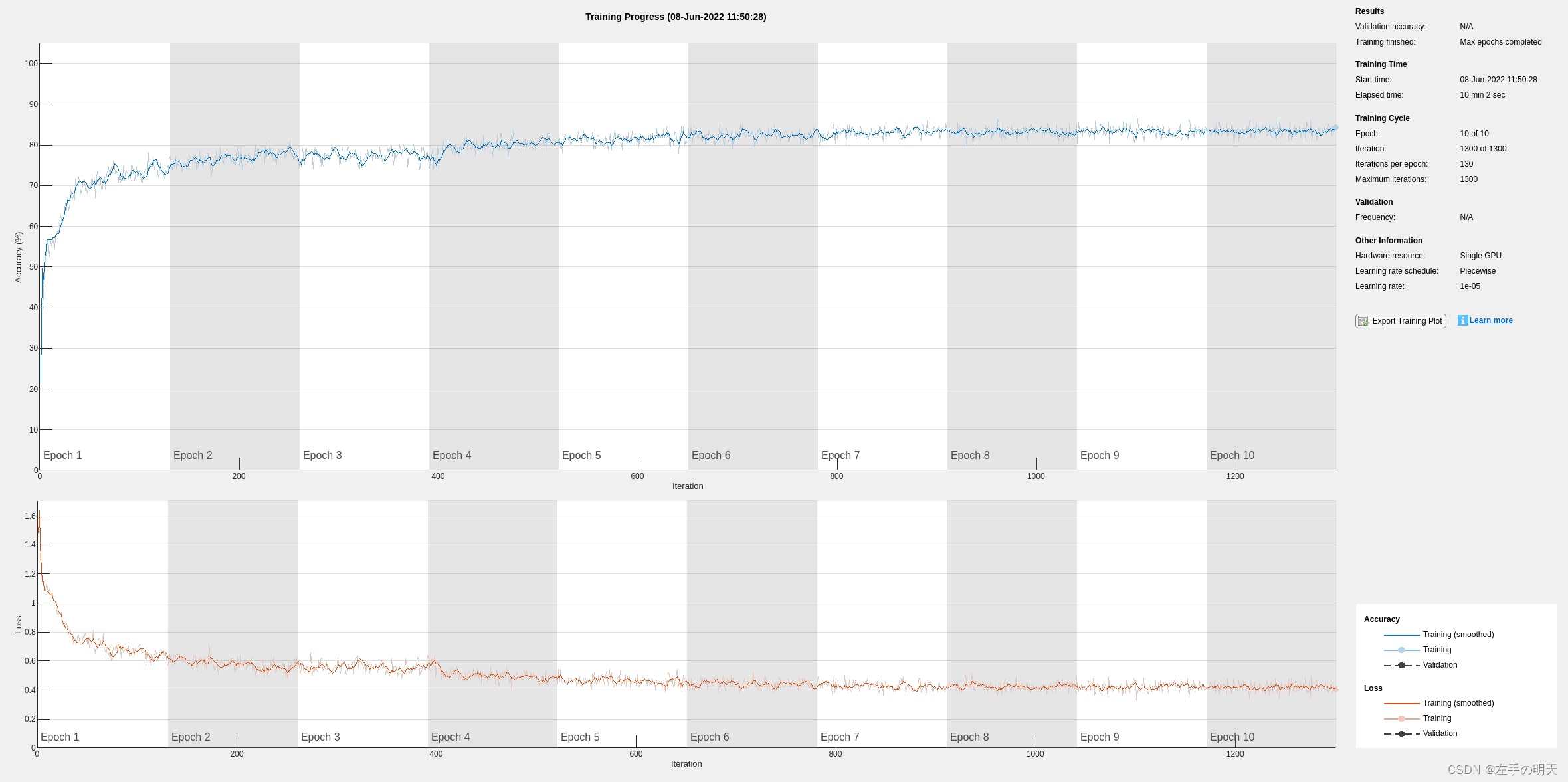

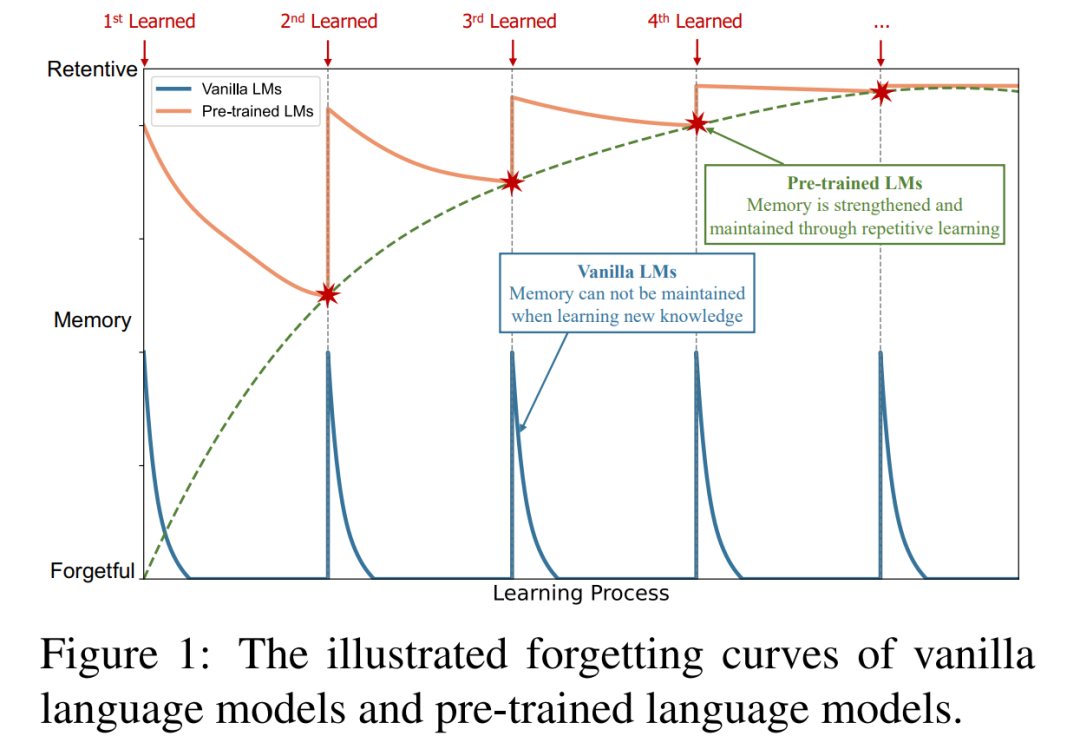

预训练语言模型的出现,相对于之前传统神经网络模型,展现出了强大的记忆能力,作者为了探究语言模型的记忆机理,采用的知识问答的测试过程,使用从Wikidata中抽取的LAMA数据集三元组作为事实知识进行学习,一共包括23种关系,每种关系包括10000个知识,在训练过程中,将知识三元组转化为自然语言进行学习,如<Steve Jobs, birthplace, California>转化为“Steve Jobs was born in California。通过事实知识的询问进行判断模型是否记住了之前的知识,并且绘制了Figure 1所示的记忆曲线,并根据曲线得出了3个结论,

1)普通语言模型容易遗忘;

2)预训练能够使语言模型记忆力变强;

3)知识相关性和多样性会影响记忆形成。

普通语言模型

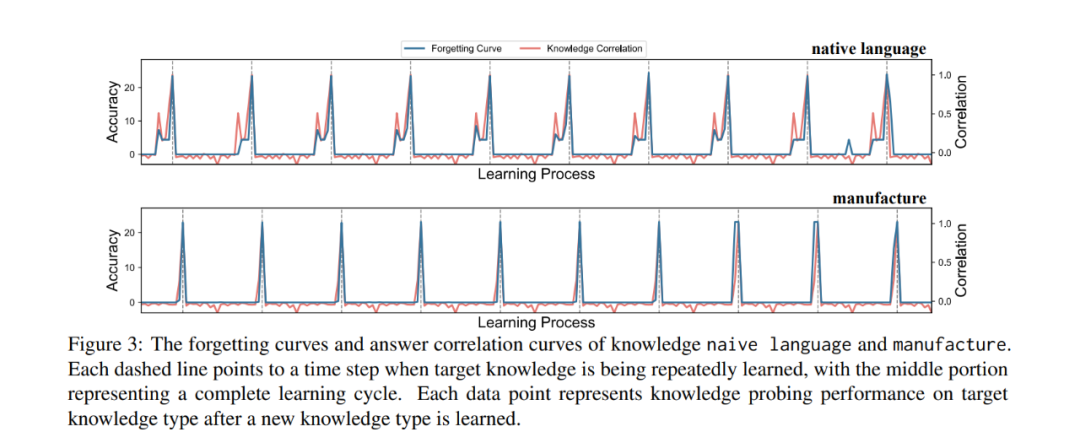

在普通语言模型上进行知识记忆实验,如上图,虚线为目标知识,得到对应的知识记忆曲线,语言模型在刚学完目标知识时,曲线明显上升,说明语言模型具有记忆能力,并且能够记住刚学会的知识,但是随着学习过程的更新,获得新知识后,对老知识的遗忘非常的快,甚至在有些情况下有下降到0的表现,证实了普通语言模型的灾难性遗忘的特点,并且随着学习过程的重复,普通语言模型并不能够有进步,表明重复学习对普通语言模型的效果有限。总得来说普通语言模型的记忆特点是短且易遗忘。

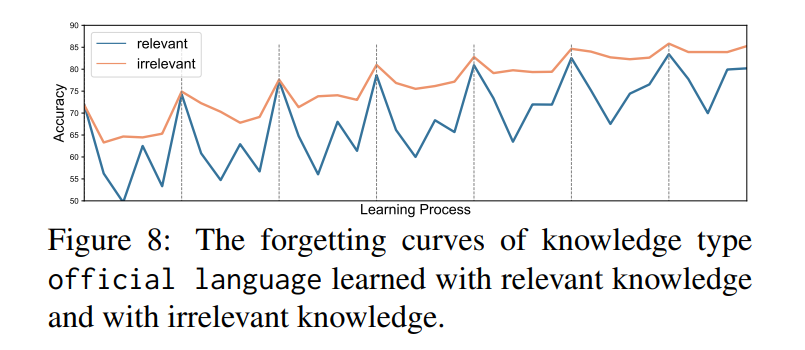

但在有些情况下,学习新知识后,记忆曲线的下降并没有那么的快,作者找出这些点,发现此时学习的新知识和目标知识相关性较高,具体过程如Figure3中的红线,可以发现记忆曲线与知识相关性高度拟合,进一步证明了普通语言模型的表现仅与刚学的知识的内容有关,普通语言模型记忆力差。

预训练语言模型

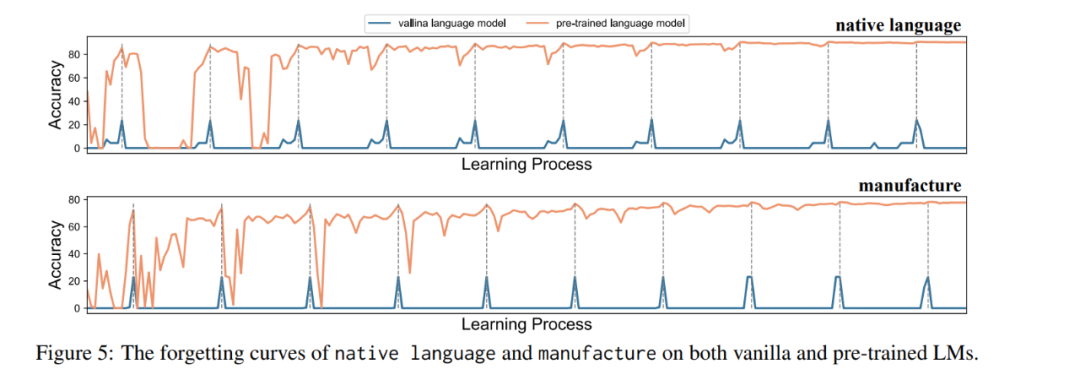

在预训练语言模型上进行了相同的实验,如Figure 5中的橙色曲线,蓝色曲线为普通语言模型的表现,相对于普通语言模型,预训练语言模型的在初期和传统语言模型的表现类似,也出现了学习新知识后在目标知识上的准确率快速下降,并且随着重复学习,预训练模型的准确率不断地提高,并且新知识的学习并不会引起模型准确率明显的下降,总的来说预训练语言模型的记忆是长期的,强健的,并且重复学习对模型的准确率提高有明显的帮助。

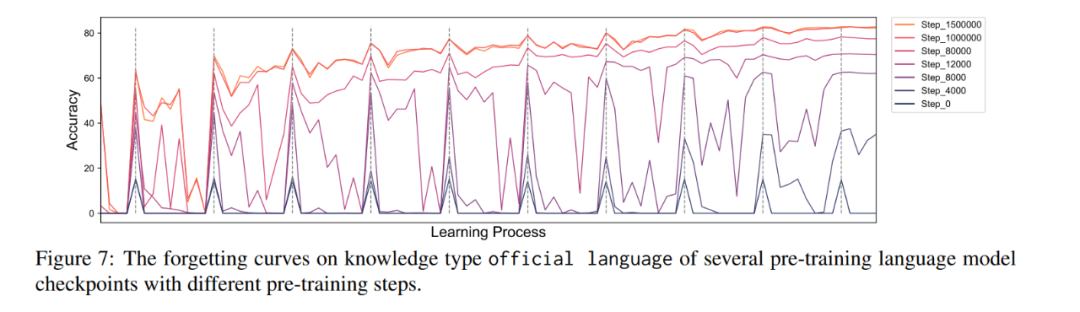

为了验证预训练是使得预训练语言模型和普通语言模型产生区别的原因,并且定量的分析预训练如何影响模型的记忆能力,作者抽离出若干个与预训练次数不同的语言模型,在相同的知识记忆测试进行实验。在Figure 7中,在预训练次数较少时,预训练模型与普通模型的区别不大,随着预训练次数的不断提高,特别是当预训练次数大于80000时,模型的准确率明显提高,并且重复学习能够明显提高模型的记忆能力,由此得出结论,预训练是使得模型具有强大记忆力的原因。

知识相关性和多样性对记忆形成的影响

在预训练模型的重复学习过程中,虽然模型的准确率随着重复学习的次数不断提高而提高,但是还是会存在在学习完部分知识后,模型准确率反而下降,在单独抽取出这些知识后,作者发现这些知识都是与目标知识高度相关的知识,由此作者提出了一个猜想,知识的相关性会带来竞争。为此作者设计了实验,统一语言模型分别学习知识相关度高的知识集合,和知识相关度低的知识集合,发现在知识相关度低的知识集合上模型的表现明显好于另一类,并且在相关度较低的出现的记忆退化也明显较少。

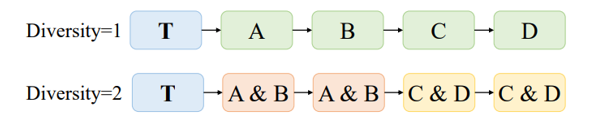

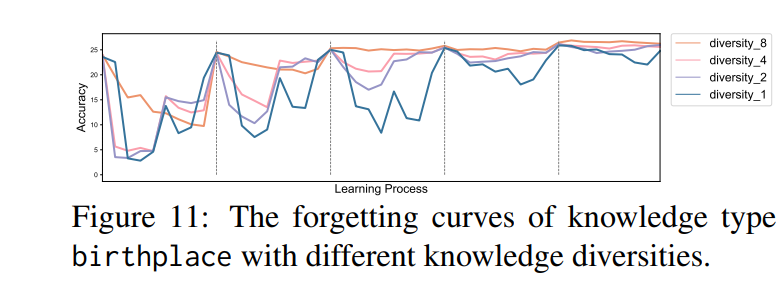

通过提高每次学习知识的种类,通过两次A&B的方式来取代一次A,一次B的知识学习模式,作者通过对比每次学习一种类型知识和多种类型知识,发现随着知识的多样性的上升,模型的记忆曲线也不断地提高,且灾难性遗忘的回落出现次数也减少,表明每次学习过程中知识的多样性对记忆的形成有正向作用。

总结与展望

本文研究了普通语言模型和预训练语言模型的记忆机制,发现:1)普通语言模型容易遗忘;2)预训练可使语言模型记忆能力增强;3)知识相关性和多样性显著影响记忆形成。这些发现有助于启发许多其他研究。首先,语言模型的记忆机制可以为以前的许多研究提供有用的解释,如灾难性遗忘的原因和预训练的影响。其次,通过揭示影响预训练语言模型记忆的几个关键因素,可以为PLM设计更稳定可靠的学习算法。最后,作者发现语言模型的记忆模式可能类似于人脑,这为连接人工智能和心理学的研究提供了启发。

本文还提出了许多未来研究的开放性问题:1)预训练为何会导致如此显著的遗忘-保留转变,预训练期间是否还有其他同步的转变?2)除了重复学习、预训练和知识多样性,是否还有其他关键因素影响记忆能力?3)大脑和语言模型的记忆之间有哪些关键差异?实现类似于大脑的记忆需要哪些能力?

OpenKG

OpenKG(中文开放知识图谱)旨在推动以中文为核心的知识图谱数据的开放、互联及众包,并促进知识图谱算法、工具及平台的开源开放。

点击阅读原文,进入 OpenKG 网站。